Dlaczego copiloty do kodu wywracają programowanie w 2026

Copiloty do kodu w 2026 roku nie są już ciekawostką z konferencji ani gadżetem dla entuzjastów AI. Dla wielu zespołów stały się tak samo krytyczne jak system kontroli wersji czy CI/CD. Zmienił się zarówno poziom ich możliwości, jak i sposób, w jaki firmy organizują wokół nich pracę.

Jeszcze 2–3 lata temu dominował prosty schemat: copilot do programowania podpowiadał kilka kolejnych linii na podstawie aktualnego pliku i odrobiny kontekstu. Dziś te narzędzia potrafią przeanalizować setki plików, historię commitów i dokumentację, a następnie zaprojektować i wprowadzić spójne zmiany w wielu modułach jednocześnie. To już nie „autouzupełnianie 2.0”, tylko realny współautor kodu, który współdecyduje o kształcie funkcji, klas, a czasem całych komponentów systemu.

Widać też zmianę w mentalności zespołów developerskich. Tam, gdzie wcześniej obawiano się „psucia kodu przez AI”, dziś bardziej boi się sytuacji odwrotnej: że zespół zostanie z tyłu, bo konkurencja lepiej wykorzysta automatyzację pisania kodu. Copilot nie jest już luksusem – w wielu organizacjach jest wpisany w standardowe środowisko pracy, z politykami bezpieczeństwa, procesami wdrożenia i szkoleniami dla programistów.

To wpisuje się w szerszy trend automatyzacji pracy umysłowej. Tak jak księgowi przestali ręcznie dodawać liczby dzięki arkuszom kalkulacyjnym, tak programiści coraz rzadziej ręcznie klepią boilerplate, standardowe integracje czy proste testy. AI pair programming w praktyce oznacza, że spora część „mechanicznego” kodowania schodzi z agendy, a uwaga przesuwa się na projektowanie rozwiązań, rozumienie domeny i weryfikację tego, co zaproponuje copilot.

Największy wpływ w 2026 roku mają trzy zjawiska:

- zwiększony kontekst – copiloty widzą już nie tylko pojedynczy plik, ale i strukturę całego projektu oraz otoczenie biznesowe (tickety, dokumentacja, logi),

- głębsza integracja z cyklem życia aplikacji – od projektowania po produkcję i monitorowanie,

- personalizacja – modele uczą się na kodzie konkretnego zespołu i różnicują wsparcie w zależności od roli i poziomu doświadczenia.

Dzięki temu realnie rośnie produktywność programistów z AI, ale też pojawia się nowe ryzyko: utraty kontroli nad tym, co faktycznie wchodzi do bazy kodu. W 2026 roku wygrywają nie ci, którzy „mają copilota”, lecz ci, którzy potrafią go świadomie włączyć w proces wytwarzania oprogramowania.

Jak działają współczesne copiloty do kodu – krótko, ale konkretnie

Architektury modeli i co z tego wynika dla programisty

Za współczesnymi copilotami stoją duże modele językowe (LLM), ale nie w wersji „ogólna papuga tekstu”. Najlepsze rozwiązania łączą:

- modele ogólne – wyszkolone na ogromnych korpusach tekstu (dokumentacja, Q&A, blogi techniczne),

- modele specjalizowane w kodzie – trenowane dodatkowo na repozytoriach open source i korporacyjnych kodach (często prywatnych),

- warstwę retrieval – czyli inteligentne wyszukiwanie fragmentów kodu i wiedzy pasujących do aktualnego kontekstu.

Modele wyspecjalizowane w kodzie lepiej rozumieją składnię, wzorce projektowe i typowe idiomy w językach programowania. Potrafią na przykład zachować spójność typów w TypeScript czy poprawnie zarządzać pamięcią w C++ bez dodatkowych podpowiedzi. Z kolei modele ogólne z finetuningiem kodowym sprawdzają się lepiej w zadaniach, gdzie trzeba łączyć kod z dokumentacją, komunikacją z biznesem, opisem wymagań.

Kluczowa różnica w 2026 roku to obsługa bardzo dużego kontekstu projektowego. Copilot nie analizuje już wyłącznie kilku otwartych plików. Najnowocześniejsze rozwiązania potrafią:

- wczytać strukturę całego monorepo i utrzymywać jej reprezentację w pamięci,

- zrozumieć zależności między modułami, mikroserwisami, kontraktami API,

- sięgnąć po historię commitów, aby zobaczyć, jak podobny problem był już rozwiązywany.

Do zarządzania tak dużą ilością informacji używa się wektorowych wyszukiwarek (embeddings). Każdy plik, funkcja, a czasem nawet fragment dokumentacji jest przeliczany na wektor w przestrzeni liczb. Gdy prosisz copilota o zmianę, system:

- przekształca Twoje polecenie na wektor,

- odnajduje najbardziej podobne wektory w bazie (np. powiązane klasy, wcześniej pisane integracje),

- dołącza znalezione fragmenty jako kontekst do modelu generującego kod.

W praktyce oznacza to, że copilot w 2026 nie musi „na ślepo zgadywać”. Ma realny przegląd tego, jak w Twoim projekcie realizuje się logowanie, obsługę wyjątków czy wzorce DDD. Dzięki temu generuje kod bliższy standardom zespołu, a nie tylko „średnią z GitHuba”.

Co copilot „widzi”, gdy generuje kod

Przy każdej generacji copilot do programowania korzysta z określonego zestawu informacji. Im lepiej rozumiesz ten zestaw, tym precyzyjniej potrafisz sterować narzędziem.

Typowy zakres kontekstu obejmuje:

- otwarte pliki – kod, testy, pliki konfiguracyjne, komentarze,

- powiązane pliki z repozytorium – np. wszystkie klasy implementujące dany interfejs,

- opis zadania – ticket z Jiry, Trello czy Azure DevOps,

- logi i stack trace – jeśli kopilot jest zintegrowany z systemem monitoringu,

- dokumentację techniczną – pliki Markdown, Confluence, wiki zespołu.

Nowością 2025–2026 jest to, że copiloty świadomie dopasowują się do stylu zespołu. Analizują:

- konwencje nazewnicze (np. snake_case vs camelCase, prefiksy w nazwach mikroserwisów),

- preferowane frameworki i biblioteki (czy używacie Reacta, Vue, Svelte, a może czystego JS),

- typowe wzorce architektoniczne (CQRS, hexagonal, event sourcing),

- przyjęte praktyki testowania (TDD, BDD, snapshoty, testy kontraktowe).

Na tej podstawie potrafią generować kod, który:

- używa tych samych bibliotek co reszta projektu,

- trzyma się ustalonych konwencji,

- od razu zawiera szkice testów w stylu używanym w repozytorium.

Granice tych możliwości wciąż są jednak wyraźne. Copiloty nadal potrafią:

- „zmyślać” API – sugerować metody, których w danej bibliotece nie ma, bo kojarzą je z podobnych narzędzi,

- mylić szczegóły konfiguracji frameworków, szczególnie w niszowych stackach,

- nie dosłyszeć niuansów domeny biznesowej, jeśli nie ma ich wprost w kodzie lub dokumentacji.

Dlatego bezrefleksyjne akceptowanie propozycji wciąż kończy się bugami. Największa zmiana w 2026 polega nie na tym, że błędy zniknęły, tylko na tym, że powstają z innej przyczyny: programista nie rozumie już szczegółów kodu generowanego przez AI, bo traktuje copilota jak „czarną skrzynkę”.

Przegląd najważniejszych copilotów do kodu w 2026 roku

Duzi gracze: GitHub, Amazon, Google, JetBrains, Microsoft

Rynek kopilotów do kodu 2026 to już nie jeden dominujący produkt, ale ekosystem kilku dużych graczy oraz dziesiątek specjalistycznych rozwiązań. Większość narzędzi od dużych dostawców oferuje dziś podobny zestaw funkcji bazowych, który można uznać za standard:

- autouzupełnianie kodu – podpowiedzi całych linii, bloków funkcji, a czasem kompletnych komponentów,

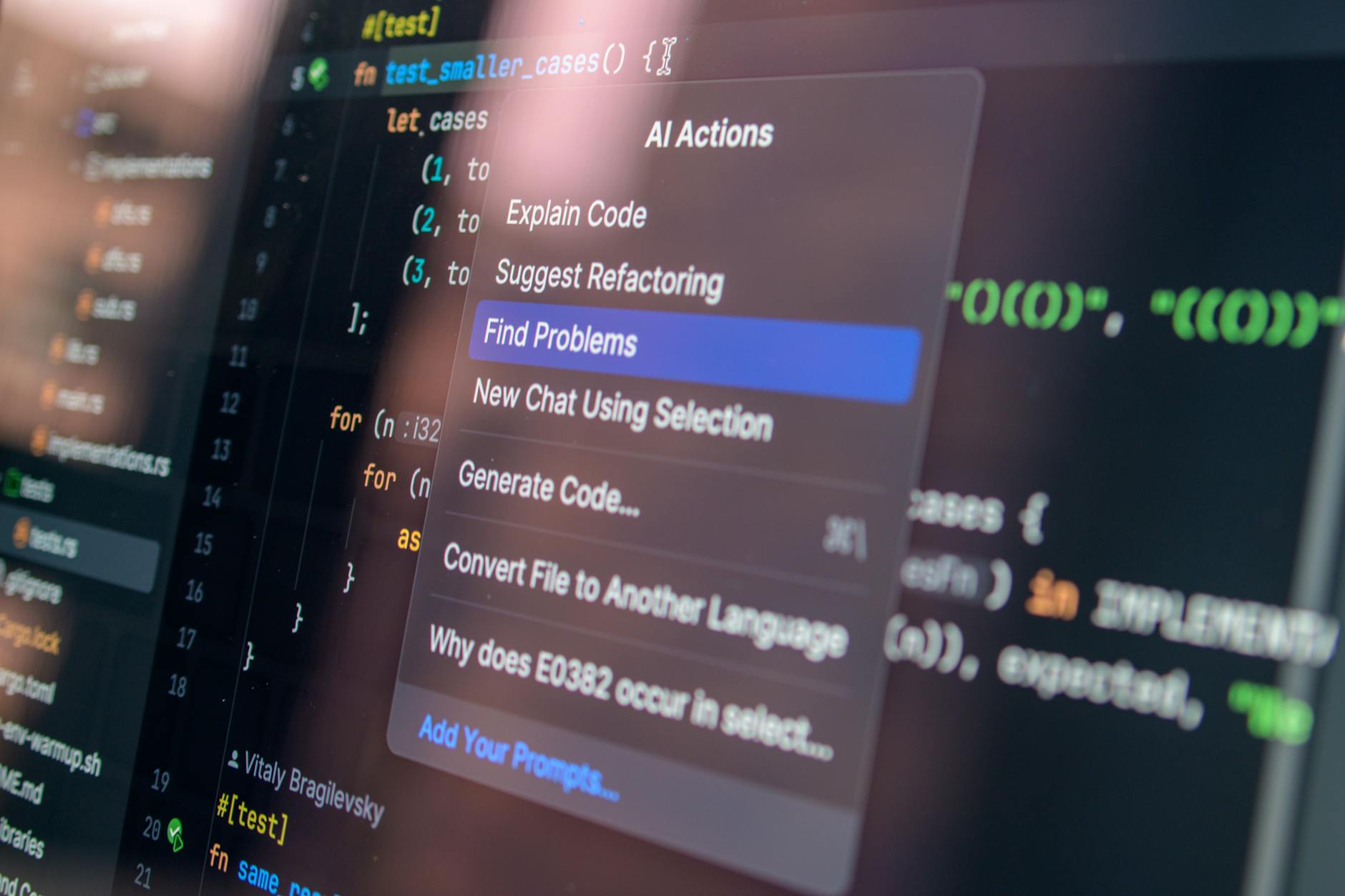

- chat w IDE – możliwość zadawania pytań o kod, framework, błędy, z dostępem do kontekstu projektu,

- generowanie testów – tworzenie testów jednostkowych, komponentowych i prostych testów integracyjnych,

- refaktoryzacja – sugerowanie prostych refaktorów, wydzielanie metod, porządkowanie importów, zmiana nazw.

Nowe funkcje, które stały się powszechne w latach 2025–2026, wyraźnie przesuwają punkt ciężkości w stronę pracy zespołowej i zarządzania zmianami:

- analiza pull requestów – copilot sam komentuje PR, wskazuje potencjalne bugi, niespójności stylu, luki w testach,

- auto-fixy – przy typowych uwagach z code review copilot potrafi zaproponować automatyczne poprawki,

- zmiany wieloplikowe – generowanie spójnych zmian w wielu plikach przy jednej komendzie (np. dodanie nowego pola w DTO, warstwie serwisu i API),

- migracje frameworków – półautomatyczne przejścia między wersjami frameworków lub nawet między frameworkami (np. z Enzyme na React Testing Library).

Istotnym tematem stały się też modele prywatne vs chmurowe. Duzi dostawcy oferują zwykle trzy warianty:

- model publiczny w chmurze – najwyższa jakość, ale dane kodu wychodzą poza infrastrukturę firmy, choć zwykle z silnymi gwarancjami,

- model private cloud – oddzielona instancja modelu, bez mieszania z innymi klientami,

- model on-premise lub w VPC – działający w infrastrukturze klienta, z gorszą skalą, ale silną kontrolą nad danymi.

Różnice w jakości i szybkości są realne. Modele chmurowe zwykle jako pierwsze dostają najnowsze architektury (więcej parametrów, lepsza obsługa długiego kontekstu). Modele on-premise nierzadko bazują na „poprzedniej generacji” technologii, ale za to pozwalają firmom spełnić wymagania prawne i compliance w obszarach wrażliwych (finanse, medycyna, sektor publiczny).

Rozwiązania on-premise i specjalistyczne copilotów

Obok gigantów wyrósł osobny segment rynku: self-hosted copiloty do kodu dla firm wrażliwych na dane. Ich celem jest umożliwienie korzystania z AI pair programming przy pełnej kontroli nad tym, gdzie trafia kod źródłowy. Typowa architektura takiego rozwiązania obejmuje:

- model LLM (często open-source’owy) wdrożony w klastrze Kubernetes lub na serwerach bare-metal,

- wektorową bazę danych z indeksami kodu z wewnętrznych repozytoriów,

- pluginy do najpopularniejszych IDE,

- integracje z firmowymi systemami: autoryzacja SSO, Jira, GitLab, Bitbucket, systemy logowania i monitoringu.

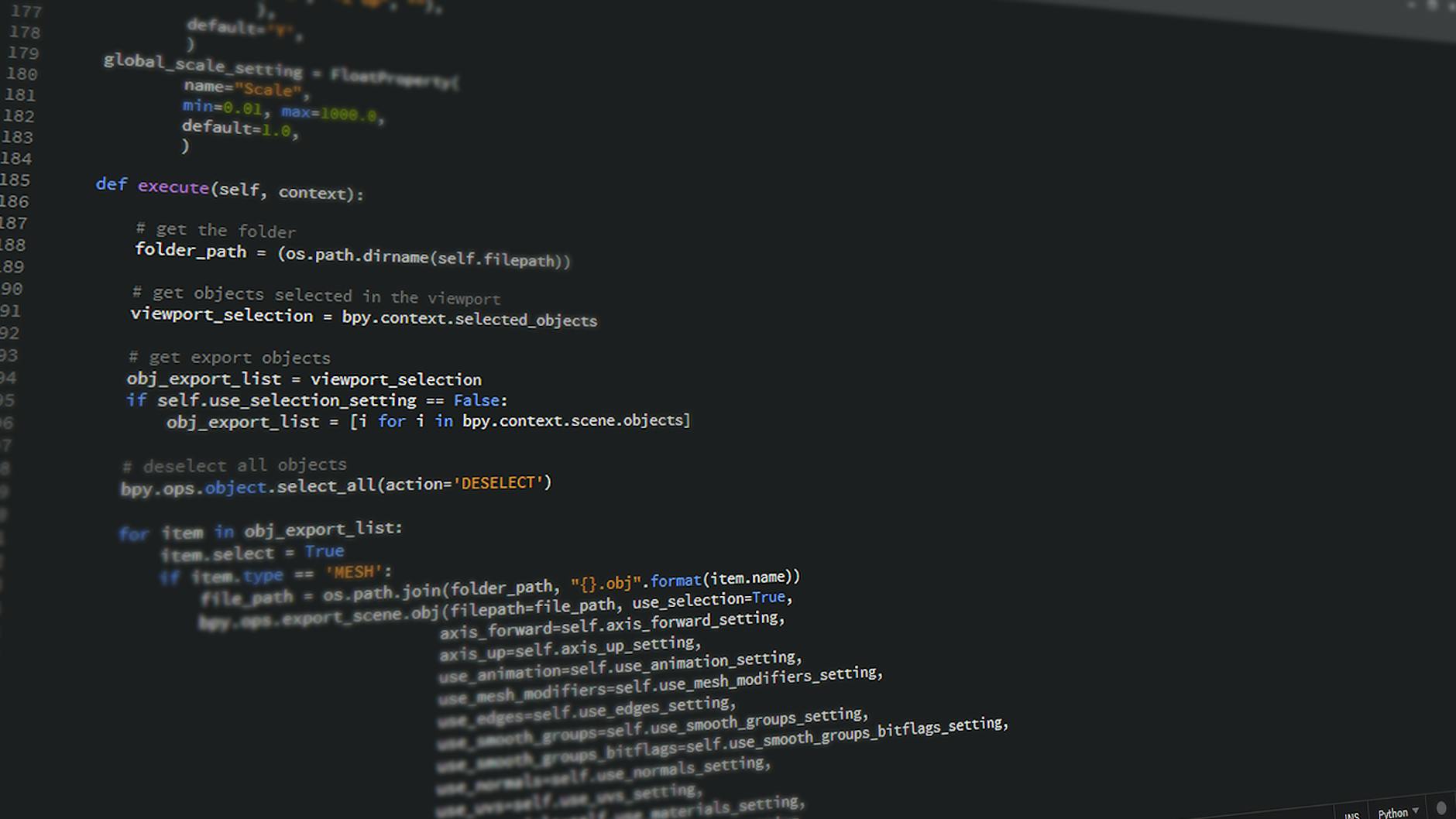

Coraz więcej jest też copilotów fokusowanych na konkretny język lub stack. Pojawiają się wyspecjalizowane narzędzia do:

- embedded C/C++ i systemów wbudowanych, gdzie ważna jest optymalizacja pod pamięć i czas wykonania,

- świata data & ML – generowania pipeline’ów w Airflow, transformacji w dbt, notebooków w PyTorch / TensorFlow,

- mainframe i COBOL – półautomatycznej modernizacji starych systemów.

Mniejsi dostawcy nie wygrywają skalą modeli, tylko dobrym zrozumieniem niszy i integracjami. Typowe przewagi:

- głębokie dopasowanie do jednego IDE lub narzędzia devops (np. ścisła integracja z GitLab CI/CD),

- specjalne reguły bezpieczeństwa dla danej branży (np. ochrona przed generowaniem wzorców niezgodnych z regulacjami),

- elastyczny model licencjonowania – ważne dla małych zespołów i software house’ów.

| Typ copilota | Główni dostawcy | Typowe zastosowania | Plusy | Minusy |

|---|---|---|---|---|

| Chmurowy, ogólny | GitHub, Google, Microsoft | Projekty web, mobile, backend | Najwyższa jakość, szybkie aktualizacje | Kod wychodzi poza infrastrukturę firmy |

| Private cloud / VPC | Duzi vendorzy, rozwiązania enterprise | Średnie i duże firmy, dane wrażliwe | Lepsza kontrola nad danymi | Wyższy koszt, trudniejsze wdrożenie |

| On-premise, self-hosted | Open-source + vendorzy niszowi | Sektor publiczny, finanse, medycyna | Pełna kontrola, zgodność z regulacjami | Słabsze modele, konieczność utrzymania |

| Specjalistyczny (stack | ||||

| Specjalistyczny (stack / domena) | Niszowi vendorzy, zespoły wewnętrzne | Stacki legacy, domeny regulowane, niszowe języki | Dopasowanie do realnych potrzeb, integracje „pod klucz” | Węższy zakres zastosowań, zależność od jednego dostawcy |

Co nowego w 2026 – konkretne usprawnienia, które czuć w pracy

Zmiany wieloplikowe, które naprawdę działają

W 2024–2025 wiele narzędzi obiecywało „multi-file edits”, ale w praktyce kończyło się na poprawkach w dwóch–trzech plikach i ręcznym domykaniu reszty. W 2026 takie operacje zaczynają przypominać pracę z junior-developerem, który rozumie projekt, a nie tylko pojedynczy plik.

Typowe scenariusze, które copilot ogarnia dziś znacznie lepiej:

- dołożenie nowego pola biznesowego – aktualizacja encji, DTO, mapperów, kontraktów API, walidacji i testów,

- zmiana kontraktu serwisu – dostosowanie kontrolerów, wywołań w frontendzie i testów integracyjnych,

- konsekwentna zmiana nazwy pojęcia domenowego – np. „Client” → „Customer” w kilkudziesięciu plikach.

Różnica polega na tym, że copilot nie działa już „w ciemno”. Najpierw buduje mapę powiązań (np. na bazie analizy drzewa zależności i referencji symboli), a dopiero potem proponuje zmiany. Coraz częściej pokazuje też plan modyfikacji przed wykonaniem:

- lista plików do zmiany,

- krótki opis, co zostanie zaktualizowane w każdym z nich,

- wskazanie fragmentów, co do których ma niską pewność (i prosi o potwierdzenie).

Dobry nawyk na 2026: zamiast prosić copilota o „zrób mi to”, lepiej formułować zadania jak mini-specyfikację. Np.: „Dodaj pole `preferredLanguage` do modelu użytkownika we wszystkich warstwach, wraz z walidacją i testem integracyjnym dla API.” Efekt końcowy jest dużo bliższy temu, czego faktycznie oczekujesz.

Copilot jako „reviewer pierwszego kontaktu”

Code review w wielu zespołach przesunęło się o jeden poziom wyżej. Standardem stał się schemat:

- autor wrzuca PR,

- copilot robi pierwszy pass,

- dopiero potem wchodzi człowiek-reviewer.

AI reviewer nie zastępuje człowieka, ale przesiewa najprostsze problemy techniczne:

- niespójne nazwy, powtórzony kod, oczywiste miejsca na refaktoryzację,

- brak pokrycia testami nowych ścieżek kodu,

- naruszenie uzgodnionych reguł (np. zakaz bezpośredniego dostępu do repozytorium z warstwy kontrolera).

W 2026 copilot w code review jest w stanie:

- powiązać zmiany z konkretnymi ticketami i dopytać, czy dana modyfikacja na pewno jest w zakresie,

- pokazać potencjalne regresje poprzez porównanie z wcześniejszymi PR-ami o podobnym charakterze,

- zasugerować brakujące testy w stylu używanym w repozytorium (np. dopisać analogiczny test parametrów edge-case).

W praktyce skraca to czas, w którym seniorzy zajmują się „śmieciami” (style, literówki, oczywiste edge-case’y). Ich uwaga przesuwa się na kwestie architektoniczne i zgodność z domeną.

Refaktoryzacja na poziomie modułów, a nie tylko funkcji

Wczesne copiloty radziły sobie z refaktoryzacją funkcji lub klasy. W 2026 coraz częściej spotyka się narzędzia, które rozumieją moduł jako całość: domenę, kontrakty, granice odpowiedzialności.

Typowe nowe możliwości:

- wydzielenie nowego modułu z monolitu z zachowaniem kontraktów (np. nowy mikroserwis rozliczeń),

- przenoszenie logiki z kontrolerów do warstwy domenowej wraz z dopisaniem testów,

- porządkowanie „przeciekających” warstw (wyłapanie miejsc, gdzie UI sięga bezpośrednio do repozytorium).

Nie jest to w pełni automatyczne – copilot zwykle przedstawia dwie–trzy propozycje podziału i prosi o wybór kierunku. Dobrze sprawdza się tu prosty schemat pracy:

- opisujesz, jaki problem chcesz rozwiązać („ten moduł `Billing` jest zbyt duży i wymieszany z `Orders`”),

- prosisz o analizę zależności i propozycję podziału,

- wspólnie z copilotem iterujesz nad planem i dopiero na końcu generujesz zmiany w kodzie.

Świadome zarządzanie „długim kontekstem”

Modele używane w 2026 mają znacznie większe okna kontekstu, ale to nie oznacza, że można wrzucić do nich całe monorepo i oczekiwać cudów. Największy skok jakościowy dało sprytne dobieranie kontekstu, a nie tylko jego rozmiar.

Nowe copiloty potrafią m.in.:

- budować kontekst na podstawie ścieżki zmian w Git – dorzucać do promptu powiązane commity,

- analizować ostatnie błędy z produkcji i logi, gdy pytasz o regresję,

- priorytetyzować pliki z wysoką „bliskością semantyczną” (np. wszystkie klasy korzystające z tego samego use case’a).

Programista ma nad tym większą kontrolę. W dobrych implementacjach widać dziś jawnie:

- które pliki i fragmenty trafiły do kontekstu zapytania,

- skąd pochodzą poszczególne cytaty w odpowiedzi (tzw. źródła RAG),

- jaką wagę miały poszczególne dokumenty (np. „specyfikacja API” vs „stary ticket z Jiry”).

Prosty nawyk, który szybko się spłaca: przed większym poleceniem do copilota upewnić się, że ma „pod ręką” właściwe pliki. Czasem lepiej otworzyć dodatkowe klasy i dokumenty niż liczyć, że narzędzie samo trafi na odpowiedni fragment w repozytorium.

Integracja z pipeline’ami CI/CD i monitoringiem

Copilot w 2026 to już nie tylko plugin w IDE. Coraz częściej działa jako agent w pipeline’ach i w systemach monitoringu.

Przykładowe zastosowania:

- automatyczna analiza nieprzechodzących buildów – propozycje poprawek do testów lub konfiguracji,

- suggest-fix dla alertów produkcyjnych – copilot łączy stack trace z konkretną zmianą w kodzie i sugeruje patch,

- propozycje optymalizacji kosztów – np. analiza konfiguracji serverless pod kątem zbędnych alokacji pamięci.

W praktyce wygląda to tak, że developer zamiast przekopywać się ręcznie przez logi, może poprosić: „Pokaż, które commity z ostatnich dwóch tygodni najprawdopodobniej spowodowały wzrost błędów 5xx w serwisie payments.” Copilot wskazuje kilka fragmentów kodu i od razu sugeruje hipotezy do sprawdzenia.

Lepsze rozumienie testów i jakości

Copiloty w 2026 dużo sprawniej operują na poziomie strategii testowania, a nie tylko pojedynczych case’ów. Zaczynają rozumieć, po co testujesz, a nie tylko jak.

Nowe możliwości obejmują m.in.:

- analizę pokrycia testami dla konkretnych ścieżek biznesowych, a nie ogólnego coverage’u,

- sugerowanie minimalnego zestawu testów dla nowej funkcjonalności (unit + integracja + e2e smoke),

- wyłapywanie „martwych testów” – takich, które niczego sensownego nie weryfikują.

Zespoły, które świadomie z tego korzystają, często zmieniają flow pracy:

- opis domenowy / ticket,

- razem z copilotem szkic testów wysokiego poziomu,

- dopiero potem implementacja kodu, częściowo generowana na podstawie testów.

To nie jest „czysty TDD”, ale w praktyce przybliża wiele zespołów do bardziej test-firstowego podejścia, bez dużej zmiany nawyków.

Kto zyskuje najwięcej: profile programistów i zespołów

Juniorzy – od copy-paste do świadomej nauki

Juniorzy najbardziej odczuwają, że copilot może być zarówno turbo-doładowaniem, jak i pułapką.

Co zyskują:

- szybsze ogarnięcie nowych frameworków – copilot pokazuje idiomatyczne przykłady zamiast anonimowego kodu z blogów,

- pomoc w rozumieniu istniejącego kodu – wyjaśnienia „ludzkim językiem”, co robi dany fragment,

- podpowiedzi dobrych praktyk – od razu zintegrowane z konwencjami zespołu.

Ryzyko jest proste: „klikam Tab, ale nie rozumiem”. Junior, który nie czyta wygenerowanego kodu, po kilku miesiącach staje się operatorem narzędzia, a nie programistą. Różnicę robi kilka prostych zasad:

- zawsze przeczytaj wygenerowaną funkcję linijka po linijce,

- przed przyjęciem podpowiedzi spróbuj sam ułożyć rozwiązanie w głowie lub w pseudokodzie,

- raz dziennie wybierz jeden fragment wygenerowanego kodu i poproś copilota o dokładne wyjaśnienie, dlaczego jest taki, a nie inny.

Midzi – przyspieszenie „nudnej” części pracy

Mid-level developerzy zyskują najwięcej w miejscach, gdzie praca była dotąd powtarzalna:

- klejenie boilerplate’u – DTO, mapowanie, konfiguracje,

- pisanie prostych testów wokół istniejącej logiki,

- implementowanie podobnych endpointów lub flow UI.

Efekt uboczny jest pozytywny: więcej czasu na:

- zrozumienie domeny i architektury,

- dogłębną analizę performance’u,

- przegląd i uspójnienie istniejącego kodu.

Dla midów kluczowe staje się nauczenie się formułowania dobrych poleceń. Zamiast „napisz endpoint do tworzenia zamówienia”, lepiej:

- podać kontrakt wejścia/wyjścia,

- wskazać powiązane use case’y w systemie,

- opisać reguły walidacji i edge-case’y.

Im precyzyjniej opiszą intencję, tym bardziej copilot zachowuje się jak kompetentny pair-programmer, a nie generator przypadkowego kodu.

Seniorzy i architekci – skupienie na decyzjach, nie na składni

Seniorzy nie zyskują najwięcej na tym, że ktoś pisze za nich pętle. Prawdziwy bonus to przesunięcie ciężaru pracy w stronę decyzji:

- definiowanie granic modułów, konwencji i standardów, które copilot potem egzekwuje,

- szybsza analiza istniejących systemów (np. legacy), gdy AI przygotowuje streszczenia i mapy zależności,

- eksperymentowanie z różnymi wariantami rozwiązań – copilot może wygenerować kilka architektonicznie różnych szkiców.

Senior, który umie „uczyć” copilota stylu zespołu, multiplikuje swój wpływ. Zamiast ręcznie poprawiać te same błędy w dziesiątkach PR-ów, koduje je w regułach, przykładowych implementacjach i dokumentacji, którą AI potem wykorzystuje jako punkt odniesienia.

Realistyczny przykład:

- senior dopracowuje jeden wzorcowy moduł CQRS,

- opisuje w README, jakich zasad się trzymał,

- copilot na tej bazie pomaga midom i juniorom tworzyć kolejne moduły w podobnym stylu.

Fullstack i solo-devy – „multiplikator” kompetencji

Osoby łączące wiele ról (fullstack, tech-lead w małym zespole, indie dev) zyskują nowego „członka zespołu”, który częściowo wyrównuje braki w konkretnych obszarach.

Przykłady korzyści:

- backendowiec sprawniej ogarnia nowoczesny frontend, bo copilot podpowiada idiomatyczny kod w React/Next/Nuxt,

- frontendowiec bez dużego doświadczenia w DevOps szybciej składa sensowne pipeline’y i konfiguracje infrastruktury jako kod,

- solo-dev może utrzymać większy projekt, bo część zadań (testy, migracje, drobne refaktory) deleguje na AI.

Ważne ograniczenie: copilot nie zastąpi zrozumienia podstaw. Nadal trzeba wiedzieć, czym różni się transakcja rozproszona od lokalnej, co oznacza konkretny błąd HTTP, jak działa GC w wybranym języku. AI świetnie przyspiesza implementację, ale słabo koryguje fundamentalne nieporozumienia.

Zespoły produktowe – szybsze iteracje zamiast większych backlogów

Zespoły, które pracują blisko produktu, wykorzystują copilota przede wszystkim do skrócenia czasu między pomysłem a działającym eksperymentem.

Największe zyski pojawiają się, gdy:

Zespoły produktowe – od hipotezy do eksperymentu w jeden sprint

Największy skok jakościowy widać tam, gdzie copilot staje się częścią procesu product discovery, a nie tylko implementacji.

Typowy scenariusz w 2026 roku:

- Product owner opisuje hipotezę w ticketsach: cel biznesowy, metryki, segment użytkownika.

- Copilot generuje szkice flow UI, kontrakty API i minimalny zestaw eksperymentów A/B.

- Zespół doprecyzowuje szczegóły i wybiera wariant „MVP of MVP”.

- Implementacja trwa dni, a nie tygodnie, bo 70–80% kodu to powtarzalne wzorce.

Różnicę widać też w samej pracy z backlogiem. Zamiast „pompować” listę zadań, zespoły:

- częściej wycinają feature’y, które nie bronią się w dyskusji z copilotem (symulacja wpływu na UX, koszty utrzymania),

- szybciej adaptują istniejące komponenty – AI proponuje reuse zamiast klejenia nowych „pół-klonów”,

- automatyzują powtarzalne zadania wokół feature’ów: changelogi, release notes, podstawową dokumentację techniczną.

Przykład z życia: zespół budujący panel rozliczeniowy dla B2B zamiast tworzyć od zera kolejną tabelę faktur, prosi copilota o audyt istniejących komponentów. AI wskazuje grid używany w module zamówień, proponuje kilka modyfikacji i generuje migracje danych pod nowe pola. Czas implementacji spada o połowę, a UX pozostaje spójny.

DevOpsi i SRE – copilot jako „drugi dyżurujący”

Dla osób od utrzymania systemów copilot staje się kimś w rodzaju stałego partnera dyżuru on-call.

Najbardziej odczuwalne zmiany:

- tworzenie i utrzymanie IaC (Terraform, Pulumi, Helm) przyspiesza, bo AI pilnuje wzorców i konwencji,

- runbooki nie są już tylko statycznym wiki – copilot potrafi je czytać i wykonywać w formie pół-automatycznych playbooków,

- analiza incydentów przechodzi od „co tu się wydarzyło?” do „jak uniknąć powtórki?” dzięki automatycznym post-mortemom.

Podczas incydentu SRE coraz częściej zamiast przekopywać się przez alerty pyta wprost: „Pokaż mi trzy najbardziej prawdopodobne scenariusze przyczyny tego spike’a latencji w regionie eu-central-1 i zasugeruj kroki diagnostyczne.” Copilot łączy dane z APM, logów, zmian w infrastrukturze i proponuje konkretną kolejność działań.

Żeby wykorzystać to sensownie, zespoły SRE wprowadzają kilka prostych praktyk:

- standard repo runbooków – dobrze opisane kroki, warunki brzegowe i antywzorce,

- oznaczanie incydentów tagami domenowymi, żeby AI mogła grupować je semantycznie,

- konsekwentne trzymanie konfiguracji i skryptów w Git – copilot lepiej działa na „żywych” repo niż na notatkach w Confluence.

Orgowie nastawieni na compliance – copilot jako strażnik reguł

Branże regulowane (finanse, med, sektor publiczny) długo podchodziły do AI z rezerwą. W 2026 roku wygrywają tam organizacje, które nie próbują „chować” copilota, tylko wprost wbudowują go w procesy compliance.

Typowe zastosowania:

- automatyczne sprawdzanie, czy nowy kod dotyka „wrażliwych” modułów (płatności, dane osobowe) i wymaga dodatkowego review,

- wymuszanie użycia konkretnych bibliotek bezpieczeństwa (np. szyfrowanie, maskowanie logów),

- generowanie checklist pod audyt na podstawie rzeczywistych zmian w repozytoriach.

Copilot w tej roli ma dostęp do:

- polityk bezpieczeństwa i wzorców architektury,

- historycznych incydentów i ich przyczyn,

- mapy systemów i integracji, w tym miejsc, gdzie płyną dane wrażliwe.

Efekt: deweloper dostaje feedback „tu łamiesz politykę danych klientów, bo wysyłasz zbyt szczegółowe logi” już w momencie tworzenia PR, a nie po trzech miesiącach audytu. Seniorzy od security spędzają więcej czasu na projektowaniu zasad, mniej na ręcznym szukaniu naruszeń.

Zespoły legacy – przyspieszone „przepisywanie przeszłości”

W środowiskach z dużą ilością starego kodu copilot nie jest tyle generatorem, co tłumaczem i kartografem.

Największe zyski obserwują zespoły, które pozwalają AI najpierw „przeżuć” monolit, zanim zaczną migracje:

- automatyczne mapy zależności między modułami, klasami i komponentami,

- opis funkcjonalny modułów, powstały na bazie realnego użycia, a nie tylko nazewnictwa,

- wygenerowane propozycje wydzielenia bounded contextów i kandydatów na mikroserwisy.

Przykładowy plan pracy:

- odpalenie „audytu legacy” – copilot analizuje kod, logi i ruch w systemie,

- wspólne warsztaty architektoniczne z AI jako „sekretarzem” podpowiadającym alternatywy,

- implementacja migracji, gdzie AI generuje adaptery, fasady, testy regresyjne i skrypty migracji danych.

Zespoły, które wcześniej bały się dotykać krytycznych modułów, zaczynają je ruszać, bo mają lepszą widoczność ryzyka. Copilot pokazuje, które endpointy naprawdę żyją, a które są martwe od lat mimo groźnie brzmiących nazw.

Organizacje z dojrzałym codebase’em – copilot jako „enkoder kultury technicznej”

W firmach, gdzie kod ma już kilka generacji i warstw, najwięcej zysku przynosi traktowanie copilota jako nośnika decyzji technicznych.

Kluczowe jest świadome „karmienie” go:

- dobrze napisanymi RFC, ADR-ami i decision logami,

- wzorcowymi modułami (przygotowanymi i opisanymi przez seniorów),

- czytelną dokumentacją domenową – nawet krótką, byle aktualną.

Gdy nowa osoba dołącza do zespołu, zamiast polować na architekta, może zadać copilotowi pytania typu: „Dlaczego mamy osobny read-model dla zamówień?” albo „Kiedy używać event sourcingu, a kiedy klasycznego CRUD-a w tym systemie?”. Odpowiedzi są osadzone w realnych decyzjach firmy, a nie w abstrakcyjnych poradnikach.

Dobrze to działa zwłaszcza w rozproszonych organizacjach, gdzie „kultura kodu” rozjeżdżała się między zespołami. Copilot staje się punktem wspólnym: generuje kod i review w oparciu o te same zasady, niezależnie od lokalizacji i strefy czasowej.

Freelancerzy i konsultanci – skalowanie „jednoosobowego zespołu”

Dla freelancerów i konsultantów technicznych copilot jest czymś pomiędzy asystentem a cichym wspólnikiem.

Na co realnie przekłada się to w 2026:

- przygotowanie Proof of Concept dla klienta w ciągu kilku dni, nie tygodni,

- utrzymywanie wielu małych projektów równocześnie dzięki automatyzacji drobnicy (aktualizacje, refaktory, testy smoke),

- lepsze raporty i rekomendacje – AI generuje techniczne podsumowania w języku biznesu.

Typowy workflow freelancera:

- krótka rozmowa z klientem i zebranie wymagań,

- wspólne z copilotem rozpisanie prostego „kontraktu” – API, dane, UX high-level,

- budowa MVP, gdzie AI pomaga utrzymać spójność stacku i konfiguracji,

- przygotowanie technicznego handoveru w formie dokumentacji wygenerowanej z repo.

Kto umie jasno określać granice odpowiedzialności copilota (co automatyzujemy, czego nie ruszamy bez ręcznego review), ten bierze projekty, które jeszcze kilka lat temu wymagałyby małego zespołu.

Firmy inwestujące w „AI enablement” – nowa rola w organizacji

W większych organizacjach pojawia się nowa odpowiedzialność: osoba lub mały zespół od „AI enablementu” dla developerów. To nie jest klasyczny ML engineer, tylko ktoś na styku:

- DX (Developer Experience),

- platform engineering,

- wewnętrznego consultingu technicznego.

Zakres zadań:

- konfiguracja i utrzymanie instancji copilotów (on-prem, VPC, prywatne modele),

- organizacja „źródeł prawdy”, które karmią AI (dokumentacja, wzorcowy kod, polityki),

- szkolenia z praktycznego użycia, guidelines, code labs.

Tego typu zespół wpływa wprost na produktywność całej organizacji. To oni decydują, które repozytoria trafiają do indeksu RAG, jak chronione są dane, jakie reguły jakości są egzekwowane automatycznie. W firmach, które tego nie mają, każde wdrożenie copilota kończy się chaosem: różne zespoły korzystają z różnych narzędzi, dane lądują w publicznych chmurach, a efekt biznesowy jest rozmyty.

Programiści budujący własne „mini-copiloty” domenowe

Oprócz korzystania z gotowych rozwiązań rośnie grupa osób, które budują własne, wąsko wyspecjalizowane copiloty: do jednego produktu, jednej domeny, jednego zespołu.

Najczęściej wyglądają one jak:

- bot w Slacku/Teams, który zna całą domenę firmy i jej kod,

- wtyczka do IDE odsłaniająca dodatkowe komendy („pokaż wszystkie miejsca ryzyka X”, „wygeneruj migracje Y”),

- mały serwis webowy z interfejsem Q&A nad monorepo i dokumentacją.

Tworzenie takiego narzędzia nie wymaga już głębokiej znajomości ML. Zestaw bloczków jest gotowy: wektorowe wyszukiwarki, API modeli, integracje z Git i CI. Główna wartość to domena – wiedza o tym, jak działa konkretny biznes, a nie jak działa backpropagation.

Typowa ścieżka dla seniora, który chce zbudować teamowego copilota:

- zdefiniowanie 3–5 głównych zadań, w których AI ma pomagać (np. review pod kątem bezpieczeństwa, generowanie testów, audyt migracji),

- zebranie przykładowych „dobrych odpowiedzi” i kodu referencyjnego,

- zbudowanie cienkiej warstwy nad API modelu, która pilnuje kontekstu i reguł,

- wpięcie tego w istniejące narzędzia – IDE, GitLab/GitHub, Slack.

W ten sposób indywidualne doświadczenie programisty „materializuje się” w narzędziu, z którego korzysta cały zespół, a nawet cała firma.

Programiści zmieniający technologię lub domenę – miękkie lądowanie

Dla osób przeskakujących między językami, frameworkami lub branżami copilot staje się amortyzatorem. Zamiast kilku miesięcy „szoku technologicznego” mamy kilka tygodni intensywnego on-boardingu z AI obok.

Jak to wygląda w praktyce:

- backendowiec z .NET przechodzący na Go wchodzi w projekt z gotowym zestawem snippetów i idiomatycznych przykładów, generowanych na bazie kodu firmy,

- programista z e-commerce przechodzący do fintechu szybciej łapie zasady domenowe dzięki wyjaśnieniom copilota opartym o specyfikacje, schematy i ADR-y,

- osoba trafiająca do świata data engineering ma pod ręką „tłumacza” pipeline’ów, DAG-ów i konfiguracji klastrów.

Ważne jest jednak ustawienie oczekiwań: copilot skraca czas wejścia, ale nie zastąpi świadomej nauki. Najlepiej sprawdza się połączenie:

- codziennej pracy z nowym kodem,

- sesji pytań do AI na bazie realnych problemów,

- przeglądów z żywym mentorem raz na tydzień–dwa.

Taki układ minimalizuje ryzyko, że ktoś „przeskoczy” na nowe technologie tylko powierzchownie, korzystając głównie z autouzupełniania.

Zespoły eksperymentujące z organizacją pracy – AI jako element procesu

W 2026 część firm próbuje nie tylko nowych narzędzi, ale też nowych układów organizacyjnych opartych o AI: krótsze sprinty, mniejsze składy zespołów, zmiana ról.

Kilka obserwowalnych trendów:

- więcej „mini-zespołów” 2–3-osobowych, które dostarczają całe pionowe feature’y wspierane przez copilota,

- mniej manualnego code review, więcej „review orkiestracji”, gdzie człowiek zatwierdza wstępną analizę AI,

- częstsze releasy (nawet kilka razy dziennie), bo proces od testów po dokumentację jest częściowo generatywny.

Rola tech leada w takim układzie przesuwa się w stronę:

- projektowania procesów z udziałem AI (kiedy i gdzie wchodzi copilot, jaka jest „granica odpowiedzialności”),

- rozwijania kompetencji zespołu w pracy z tymi narzędziami,

- monitorowania jakości na poziomie systemowym, a nie pojedynczego PR-a.

Najważniejsze wnioski

- Copiloty do kodu w 2026 roku stają się elementem krytycznej infrastruktury zespołów developerskich – funkcjonują obok Git-a i CI/CD, a nie jako gadżet dla chętnych.

- Narzędzia te przeszły od prostego autouzupełniania pliku do roli współautora: analizują setki plików, historię commitów i dokumentację, a potem wprowadzają spójne zmiany w wielu modułach naraz.

- Zmienia się mentalność zespołów: większym ryzykiem niż „psucie kodu przez AI” staje się pozostanie w tyle za konkurencją, która lepiej zorganizuje pracę z copilotem.

- Kluczowe przewagi nowej generacji copilotów to zwiększony kontekst (całe monorepo, tickety, logi), głęboka integracja z całym cyklem życia aplikacji oraz personalizacja pod konkretny zespół i rolę.

- Copiloty realnie zdejmują z programistów „mechaniczne” zadania (boilerplate, typowe integracje, proste testy), przesuwając nacisk na projektowanie rozwiązań, zrozumienie domeny i code review propozycji AI.

- Nowoczesna architektura (LLM ogólne + modele kodowe + warstwa retrieval z embeddings) pozwala copilotom generować kod zgodny ze standardami danego projektu, a nie przypadkową „średnią z internetu”.

- Najwięcej zyskują zespoły, które świadomie włączają copilota w proces wytwarzania oprogramowania – z jasnymi zasadami użycia, kontrolą tego, co trafia do repozytorium, i szkoleniami z efektywnej współpracy z AI.

Bibliografia i źródła

- The State of Developer Ecosystem 2024. JetBrains (2024) – Dane o narzędziach developerskich, IDE i praktykach zespołów

- GitHub Copilot Documentation. GitHub – Opis działania GitHub Copilot, kontekst, bezpieczeństwo i integracje

- Amazon CodeWhisperer User Guide. Amazon Web Services – Funkcje, ograniczenia i bezpieczeństwo asystenta kodu AWS

- Google Gemini for Developers Documentation. Google (2024) – Zastosowania modeli Gemini w generowaniu i analizie kodu

- Microsoft Copilot for Azure and GitHub Enterprise Docs. Microsoft (2024) – Integracja copilotów z cyklem życia aplikacji i DevOps