Dlaczego w ogóle interesować się początkami programowania

Historyczne tło jako skrót do zrozumienia dzisiejszych narzędzi

Programowanie wydaje się dziś proste: edytor, kompilator lub interpreter, dokumentacja online. Jednak większość współczesnych rozwiązań ma głęboko historyczne korzenie. Bez znajomości tego tła wiele rzeczy wygląda na dziwne, przypadkowe albo „tak po prostu jest”. Gdy zna się drogę od kart perforowanych do pierwszych języków wysokiego poziomu, układ puzzli staje się spójny i logiczny.

Wiele konstrukcji, które początkujący programiści uznają za nieintuicyjne, powstało jako kompromisy sprzętowe, ograniczenia nośników danych lub skróty myślowe z czasów, gdy jeden błąd na karcie perforowanej oznaczał godzinę oczekiwania na poprawiony wynik. Nawet jeżeli dziś używa się Pythona, JavaScriptu czy Rust, korzenie tych języków sięgają Fortranu, Cobola i asemblera – a te z kolei były odpowiedzią na bardzo konkretne problemy epoki lamp elektronowych i kart.

Znajomość początków programowania pomaga więc lepiej tłumaczyć sobie: „dlaczego to jest tak, a nie inaczej” – zamiast bezrefleksyjnie zapamiętywać składnię i reguły. To oszczędza czas przy nauce nowych technologii, bo rozumie się powtarzające się wzorce, nie tylko pojedyncze przykłady.

Korzenie, które przyspieszają naukę nowych języków

W praktyce zawodowej programista rzadko zostaje przy jednym języku na całe życie. Dochodzą nowe narzędzia, frameworki, platformy. Kto rozumie, jak wyglądała droga od „przepinania kabli” w ENIAC-u do Fortranu i dalej do nowoczesnych kompilatorów, ten szybciej orientuje się w nowych abstrakcjach. Widzi, co jest stare i sprawdzone, a co jest tylko modnym opakowaniem.

Przykład: pojęcia kompilatora, linkera, maszyny wirtualnej czy interpretera nie są oczywiste, gdy ktoś zaczyna tylko od wywołania „python script.py”. Jednak gdy zna się koncepcję języka maszynowego, asemblera i pierwszych kompilatorów Grace Hopper, pojawia się rama, do której można dopiąć nowe pojęcia bez nadmiarowego wysiłku.

Dla osoby, która ma ograniczony czas na naukę, świadomość tych zależności jest kluczowa. Zamiast przerabiać każdą nową technologię od zera, buduje się „mapę mentalną” i tylko dokładane są nowe gałęzie. To jest właśnie efekt „efekt vs wysiłek” – trochę wiedzy historycznej daje duże oszczędności przy każdej kolejnej technologii.

Dziwne zachowania nowoczesnych języków i ich źródła

Wiele anomalii współczesnych języków ma proste historyczne wyjaśnienie. Przykładowo:

- ograniczenie długości linii kodu w starych kompilatorach Fortranu wynikało wprost z formatu kart perforowanych,

- numerowanie kolumn, deklaracje na początku pliku czy „tajemnicze” wyrównania pamięci to echo czasów, gdy każdy bajt był drogi,

- sposób zapisu liczb zmiennoprzecinkowych związany jest z ograniczeniami wczesnych jednostek arytmetycznych.

Zrozumienie tych źródeł pomaga również w praktyce debugowania. Zamiast traktować błędy jako magiczne „glitche” kompilatora, łatwiej przewidzieć, co stoi za daną klasą problemów: wyrównanie pamięci, kolejność ładowania modułów, reprezentacja danych. To z kolei skraca czas dochodzenia do sedna sprawy.

Wczesne decyzje projektowe, które nadal generują koszty

Wiele kosztów utrzymania współczesnych systemów wynika z decyzji podjętych kilkadziesiąt lat temu. Najlepszy przykład to systemy bankowe w Cobolu: napisane w latach 60. i 70., działają do dziś, bo ich struktura danych i logika biznesowa jest zbyt mocno związana z codziennym funkcjonowaniem instytucji, by dało się je łatwo wymienić.

Powód, dla którego wciąż utrzymuje się takie systemy, związany jest bezpośrednio z początkami języków wysokiego poziomu. Cobol został zaprojektowany jako język „czytelny dla ludzi z biznesu”, ale oparty na ograniczeniach kart perforowanych. Format danych, rekordy, pola o sztywnej długości – to wszystko było wygodne na kartach i taśmach, lecz dziś oznacza drogie migracje.

Świadomość tego typu „dziedzictwa” pomaga podejmować rozsądniejsze decyzje projektowe obecnie. Zamiast tworzyć kolejne sztywne formaty lub sztucznie komplikować architekturę, można zastanowić się: jeśli ktoś będzie utrzymywał ten system za 30 lat, co będzie dla niego największym kosztem? Takie pytanie pochodzi wprost z lekcji wyniesionych z historii początków programowania.

Prehistoria programowania – od maszyn liczących do sterowania automatycznego

Mechaniczne liczydła i kalkulatory

Pierwszym krokiem do programowania było samo mechaniczne wspomaganie obliczeń. Abakus, używany od tysięcy lat, pozwalał człowiekowi szybciej wykonywać dodawanie i odejmowanie, ale nie przechowywał żadnego programu. Wszystko zależało od wiedzy i pracy operatora. To jeszcze nie było programowanie, a jedynie narzędzie obliczeniowe.

W XVII wieku pojawiły się pierwsze mechaniczne kalkulatory: maszyna Pascala (Pascalina) i późniejsza maszyna Leibniza. Potrafiły wykonywać podstawowe działania arytmetyczne poprzez skomplikowany układ kół zębatych. Użytkownik wprowadzał liczby za pomocą pokręteł, a mechanizm wykonywał operację. Znów – nie było tu rozdziału na „program” i „dane”. Każda operacja była wykonywana osobno, ręcznie inicjowana przez człowieka.

Ograniczenie tego podejścia jest oczywiste: brak możliwości zdefiniowania sekwencji kroków do powtarzalnego wykonania. Mechaniczne kalkulatory świetnie przyspieszały pojedyncze działania, ale nie pozwalały łatwo realizować złożonych algorytmów. Do tego potrzebny był sposób zakodowania dłuższego ciągu instrukcji na jakimś nośniku – tak, by maszyna mogła podążać za nimi automatycznie.

Koncepcje programowalności sprzed komputerów

Przełom pojawił się nie w świecie liczb, lecz w przemyśle włókienniczym. Krosna Jacquarda, wprowadzone na początku XIX wieku, wykorzystywały karty perforowane do sterowania wzorem tkaniny. Każda karta określała, które nici mają się podnieść, a które opuścić w danym kroku. Zestaw kart tworzył „program” wzoru.

Krosno Jacquarda pokazało, że złożone sekwencje działań można zakodować fizycznie. Zamiast za każdym razem ręcznie ustawiać nici, tkacz wkładał określony zestaw kart, a maszyna wykonywała powtarzalny cykl ruchów. To była istotna koncepcja: oddzielenie mechanizmu wykonawczego od opisu tego, co ma być zrobione. Później dokładnie ta sama idea została przeniesiona do maszyn liczących.

Podobny kierunek widać w rozwoju organów i pianoli. Rolki papieru z otworami sterowały tym, które dźwięki i kiedy mają być zagrane. Pianola nie „rozumiała muzyki” – po prostu odczytywała fizyczny zapis sekwencji. To bardzo bliskie współczesnemu rozumieniu programu jako sekwencji instrukcji, które maszyna mechanicznie wykonuje.

Dzięki tym wynalazkom społeczeństwo i inżynierowie oswoili się z tym, że schemat działań można zapisać na niezależnym nośniku, a maszyna może ten schemat odtwarzać bez bieżącej ingerencji człowieka. Gdy później pojawiła się koncepcja programowalnej maszyny liczącej, karty perforowane i taśmy były już sprawdzonym sposobem „zapisywania zachowania” urządzenia. To skróciło drogę do akceptacji idei komputera jako czegoś więcej niż tylko szybkiej liczydła.

Narodziny idei komputera programowalnego

Charles Babbage i Ada Lovelace – komputer przed komputerem

W pierwszej połowie XIX wieku Charles Babbage zaprojektował dwie niezwykle ambitne maszyny: maszynę różnicową i maszynę analityczną. Maszyna różnicowa miała automatycznie obliczać tabelaryczne wartości funkcji, eliminując błędy ludzkie w drukowanych tabelach matematycznych. Był to krok w stronę automatyzacji zadań, które wcześniej wykonywały całe zespoły „komputerów” – ludzi liczących ręcznie.

Jeszcze ciekawsza była jednak maszyna analityczna. W projekcie Babbage’a pojawiają się elementy bardzo zbliżone do dzisiejszej architektury komputera: jednostka arytmetyczna (tzw. „młyn”), pamięć („magazyn”), jednostka sterująca oraz wejście/wyjście. Co najważniejsze, Babbage planował sterować maszyną za pomocą kart perforowanych, inspirowanych krosnami Jacquarda. Karty miały zawierać zarówno dane, jak i instrukcje.

To właśnie przy tej maszynie pojawia się postać Ady Lovelace. W swoich notatkach do opisu maszyny przeprowadziła szczegółowy zapis sposobu obliczenia wartości liczb Bernoulliego. Ten zapis jest często uznawany za pierwszy publikowany „program”. Co ważniejsze, Lovelace zastanawiała się nad tym, jak maszyna może manipulować symbolami, nie tylko liczbami. Pisała o możliwości przetwarzania muzyki czy tekstu, jeśli tylko zostaną odpowiednio zakodowane.

W notatkach Ady widać też pierwsze rozważania o algorytmach jako niezależnych od konkretnej maszyny. Opisywała procedury, warunki, powtórzenia – wszystko to, co współcześnie składa się na logikę programów wysokiego poziomu. Choć maszyna analityczna nie została zbudowana za jej życia, konceptualnie wyprzedziła ona swoje czasy o blisko sto lat.

Dlaczego projekty Babbage’a nie zostały zrealizowane

Główną przeszkodą dla zbudowania maszyny analitycznej były ograniczenia technologii XIX wieku. Aby urządzenie mogło działać, potrzebne były ekstremalnie precyzyjne części mechaniczne, wykonane z wysoką dokładnością. Produkcja takich elementów w tamtym czasie była bardzo droga i zawodna. Babbage miał problemy zarówno z finansowaniem, jak i z wykonawcami, którzy nie zawsze byli w stanie osiągnąć wymaganą jakość.

Koszty projektu rosły lawinowo. Maszyna wymagała tysięcy elementów – kół zębatych, osi, przekładni. Każdy błąd wykonania powodował kumulację luzów, co uniemożliwiało uzyskanie wystarczającej dokładności obliczeń. W efekcie projekt nigdy nie wyszedł poza etap prototypów i modeli fragmentów większej całości. Brak odpowiednich materiałów, narzędzi obróbczych i stabilnego finansowania przesądził sprawę.

Mimo to wiele koncepcji Babbage’a przetrwało:

- pomysł pamięci jako osobnego bloku przechowującego dane,

- wydzielona jednostka arytmetyczno-logiczna,

- oddzielenie programu (na kartach) od mechanizmu wykonawczego,

- koncepcja warunków i pętli w opisie działań maszyny.

Te idee wróciły w XX wieku w projektach maszyn elektromagnetycznych i elektronicznych, a później w architekturze von Neumanna. Z punktu widzenia programisty XX i XXI wieku Babbage był kimś w rodzaju architekta systemowego – projektował strukturę, którą później realizowano za pomocą bardziej dojrzałych technologii.

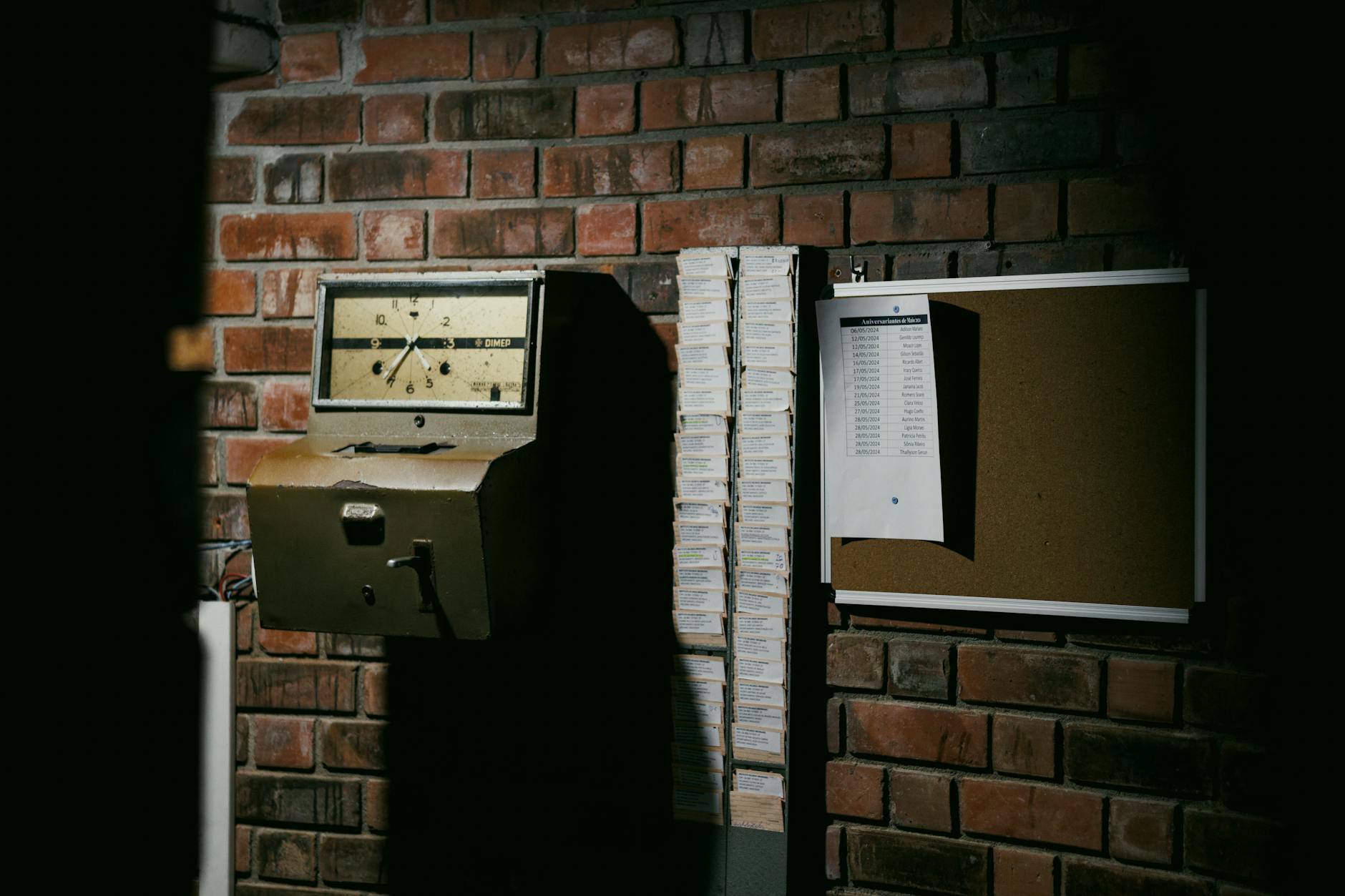

Karty perforowane – pierwszy masowy nośnik programów i danych

Herman Hollerith i przetwarzanie statystyczne

Pod koniec XIX wieku w USA pojawił się problem praktyczny: spis ludności trwał coraz dłużej, a ilość danych rosła. Ręczne zliczanie odpowiedzi stawało się nieefektywne. Herman Hollerith zaproponował zastosowanie kart perforowanych jako nośnika odpowiedzi oraz maszyn do ich półautomatycznego przetwarzania.

System Holleritha składał się z dziurkarek, którymi operatorzy przenosili odpowiedzi ze spisu na karty; tabulatorów, które odczytywały perforacje i zliczały dane; oraz sorterów, które grupowały karty według określonych kryteriów. Każda karta reprezentowała jedną osobę lub jednostkę statystyczną. Otwór w określonym miejscu znaczył np. płeć, miejsce zamieszkania, zawód.

Przepływ pracy wyglądał mniej więcej tak:

- urzędnik zbierał odpowiedzi podczas spisu,

- operator przepisywał je na kartę, dziurkując odpowiednie pola,

- karty trafiały do tabulatora, który zliczał określone kombinacje perforacji,

- sorter segregował karty, umożliwiając kolejne analizy.

Rozwiązanie Holleritha okazało się na tyle skuteczne, że stało się podstawą ogromnego biznesu. Jego firma, po serii przekształceń, stała się później IBM. Co najważniejsze, karty perforowane weszły do powszechnego użytku jako nośnik informacji – zarówno danych, jak i (nieco później) programów komputerowych.

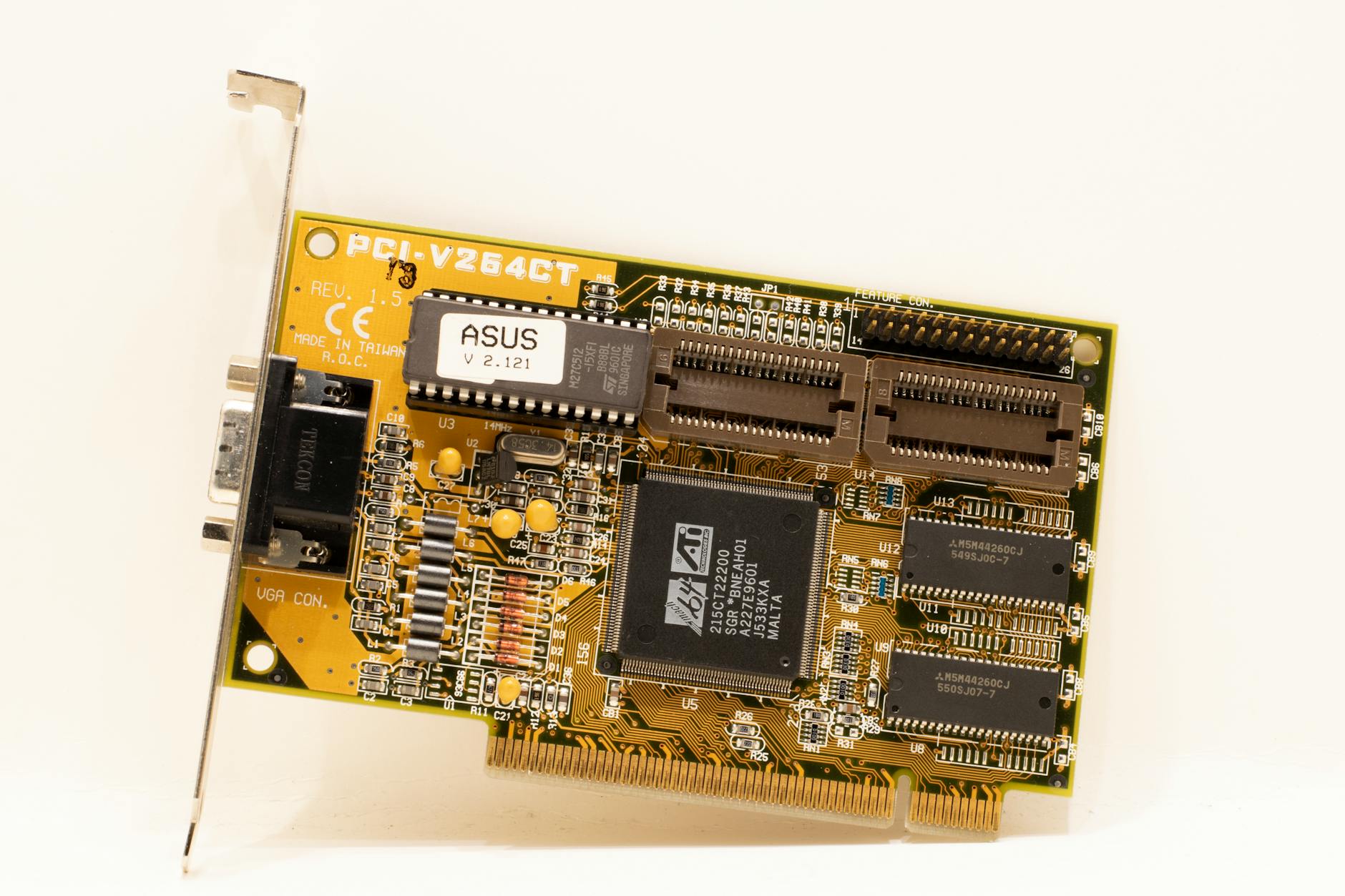

Standard IBM i ekosystem kart

Wraz z rozwojem zastosowań kart perforowanych powstał standard 80-kolumnowej karty IBM. Każda kolumna mogła zawierać znak zakodowany za pomocą odpowiedniego układu perforacji. Początkowo dominowały kody numeryczne, później dodano zestawy alfanumeryczne (m.in. kody Holleritha, a następnie EBCDIC).

Programowanie kartami – jak „pisało się” kod przed klawiaturą

Gdy karty perforowane zaczęły służyć nie tylko do statystyki, ale też do sterowania komputerami, powstał specyficzny proces programowania fizycznego. Z dzisiejszej perspektywy wygląda na skrajnie nieefektywny, ale przez dekady był standardem w uczelniach, urzędach i firmach.

Typowy cykl pracy programisty „na karty” wyglądał następująco:

- najpierw ręcznie spisywano algorytm – często w zeszycie albo na specjalnym formularzu,

- następnie operator dziurkarki przepisywał kod na karty, każda linia programu to jedna karta,

- paczka kart trafiała do kolejki zadań przy komputerze,

- po pewnym czasie (minuty, godziny, czasem dłużej) program był uruchamiany przez operatora systemu,

- wynik – wraz z ewentualnymi komunikatami błędów – trafiał na wydruk lub taśmę.

Każdy błąd składniowy oznaczał powtórkę cyklu: poprawienie linii, ponowne przedziurkowanie kart, ponowne czekanie w kolejce. To wymuszało bardzo oszczędne podejście do eksperymentów. Zamiast „spróbuję i zobaczę”, programista maksymalnie dopracowywał kod „na papierze”, zanim ktokolwiek dotykał maszyny.

Choć brzmi to archaicznie, ten sposób pracy miał jedną zaletę: uczył dobrej dyscypliny. Niewielu stać było na beztroskie testowanie w kółko – każdy błąd kosztował realny czas wielu osób: programisty, operatora, czas na maszynie. W pewnym sensie był to wymuszony „code review” na kartce.

Fizyczne ograniczenia kart jako czynnik kształtujący języki

Karta IBM miała 80 kolumn. To nie była przypadkowa liczba – stała się fizycznym „oknem”, przez które programista patrzył na kod. Konsekwencje są widoczne do dziś. Klasyczne formaty wielu języków (np. Fortranu) przewidywały:

- kolumny 1–5 – numery linii lub etykiety,

- kolumna 6 – znacznik kontynuacji w kolejnym wierszu,

- kolumny 7–72 – właściwa treść instrukcji,

- pozostałe kolumny – komentarze lub wolne miejsce.

Dzisiaj ograniczenie długości wiersza do 80 znaków bywa traktowane jako kwestia estetyki i ergonomii czytania w edytorze. Wtedy było to twarde, sprzętowe ograniczenie: linia kodu po prostu nie mogła być dłuższa niż długość karty (z uwzględnieniem przeznaczonych kolumn). To skłaniało twórców języków do dość zwięzłej składni.

Ograniczenie fizyczne kart sprzyjało też linearnemu, sekwencyjnemu stylowi programowania. Choć istniały skoki warunkowe i pętle, kod układało się w naturalną sekwencję „od góry do dołu”. Struktury danych i instrukcje musiały być na tyle proste, aby mieściły się w praktycznych granicach długości i liczby kart.

Z punktu widzenia kosztów projektów IT oznaczało to niższy próg wejścia dla operatorów, ale jednocześnie mniejszą elastyczność. Bardziej zaawansowane konstrukcje logiczne były możliwe, jednak ich koszt „logistyczny” – w postaci złożonych talii kart – szybko rósł.

Organizacja pracy z programami na kartach

W instytucjach korzystających z dużych komputerów istniało całe zaplecze organizacyjne wokół kart perforowanych. Nie chodziło tylko o sprzęt, ale też o procedury, które miały zabezpieczyć dane i ograniczyć straty czasu.

Standardem były:

- pudła i szuflady na karty – każda paczka miała swój opis, numer projektu, nazwę programu,

- sortery – maszyny pozwalające przywrócić poprawną kolejność talii, jeśli karty się wymieszały,

- kopie bezpieczeństwa – fizycznie duplikowane talie, przechowywane w innym miejscu.

Zgubienie lub rozsypanie kart z dużym programem oznaczało realny koszt: godziny składania, czasem coś w rodzaju „manualnego debugowania”, gdy pojedyncze karty brakowało lub była uszkodzona. Dlatego programiści często nanosili na karty drukowane numery sekwencyjne, które można było odczytać bez maszyn i użyć do ręcznego sortowania.

Prosty przykład: projekt obliczeniowy na uczelni. Zespół miał przydział czasu na komputer raz w tygodniu. Jeśli w piątek po południu talia kart wypadła komuś z rąk, a kolejność nie była zabezpieczona numerami, realnie cały tydzień pracy mógł pójść na marne. Sam fakt, że takie sytuacje się zdarzały, powodował rosnącą presję, by szukać bardziej elastycznych metod wprowadzania i przechowywania programów.

Komputery pierwszej generacji – od przekaźników do lamp elektronowych

Przekaźniki elektromechaniczne – pomost między mechaniką a elektroniką

Zanim pojawiły się komputery w pełni elektroniczne, wykorzystywano przekaźniki – przełączniki sterowane elektromagnesem. To rozwiązanie było znane z telekomunikacji i automatyki. Przekaźnik mógł reprezentować bit: stan „zamknięty” lub „otwarty”. Z ich kombinacji budowano bramki logiczne i rejestry.

Zaletą przekaźników była względna łatwość produkcji i niska bariera wejścia technologicznego. Firmy telekomunikacyjne miały doświadczenie z tysiącami takich elementów w centralach. Z drugiej strony przekaźniki były powolne i podatne na zużycie mechaniczne. Czas przełączania liczono w dziesiątkach milisekund, co ograniczało szybkość obliczeń, ale i tak stanowiło skok w porównaniu do maszyn w pełni mechanicznych.

Jednym z najsłynniejszych komputerów przekaźnikowych był Harvard Mark I (oficjalnie ASCC – Automatic Sequence Controlled Calculator). Wykorzystywał tysiące przekaźników i mógł wykonywać długie sekwencje operacji zapisanych na taśmach perforowanych. Programowanie polegało na przygotowaniu odpowiednio zakodowanej taśmy – koszt zmiany algorytmu był więc wysoki, a sam proces mało interaktywny.

W tej fazie rozwoju dominowało podejście, w którym program był nadal zewnętrzny wobec maszyny: przechowywany na nośniku (taśma, karty), a komputer pełnił rolę wykonawcy kolejnych instrukcji bez większej elastyczności w trakcie pracy.

Lampy elektronowe – przyspieszenie kosztem energii i niezawodności

Kolejny krok wykonały komputery oparte na lampach elektronowych. Lampa mogła pełnić rolę przełącznika znacznie szybszego niż przekaźnik. Czas przełączania spadał do mikrosekund, co dawało przyspieszenie o kilka rzędów wielkości. Typowe maszyny tej generacji miały tysiące, a czasem dziesiątki tysięcy lamp.

Przykładowe konstrukcje to m.in. ENIAC, EDVAC, EDSAC, UNIVAC I. Każda z nich trochę inaczej podchodziła do kwestii pamięci, reprezentacji danych i programowania, ale łączył je jeden problem: lampy były energochłonne i zawodne. Urządzenia grzały się, wymagały chłodzenia i regularnej wymiany elementów.

Z punktu widzenia czasu i kosztu eksploatacji oznaczało to konieczność:

- planowania zadań tak, aby maksymalnie wykorzystać dostępne okna pracy,

- ograniczania zbędnych eksperymentów – każde uruchomienie programu zużywało nie tylko prąd, ale i „życie” lamp,

- utrzymywania zespołu techników odpowiedzialnych za ciągłe naprawy.

Komputery lampowe były więc inwestycją na poziomie dużej instalacji przemysłowej. Nie kupowało się ich „dla jednego zespołu”, lecz dla całej instytucji, a czas na maszynie był ściśle przydzielany. Programista nie mógł po prostu „usiąść przy komputerze” – korzystał z niego za pośrednictwem systemu kolejkowego i operatorów.

Od programowania zewnętrznego do pamięci przechowującej program

Wczesne komputery pierwszej generacji – w tym ENIAC – były początkowo programowane w sposób bliski przełączaniu kabli i ustawianiu przełączników. Zmiana algorytmu mogła oznaczać fizyczne przestawianie połączeń. Było to nie tylko czasochłonne, ale też podatne na błędy. Dla większych zadań przestawianie mogło trwać cały dzień lub dłużej.

Kluczowy przełom przyniosła koncepcja programu przechowywanego w pamięci (stored-program computer), kojarzona przede wszystkim z pracami Johna von Neumanna i zespołów pracujących nad maszynami EDVAC, EDSAC czy Manchester Mark I. Zamiast programować maszynę poprzez kable i przełączniki, zaczęto traktować program jako dane zapisane w tej samej pamięci, w której przechowywane są liczby.

To podejście miało ogromne konsekwencje praktyczne:

- czas zmiany programu dramatycznie się skrócił – wystarczyło załadować inny zestaw instrukcji do pamięci,

- pojawiała się możliwość dynamicznej modyfikacji zachowania – program mógł modyfikować inny program lub samego siebie,

- prościej było tworzyć uniwersalne narzędzia, np. asembler, kompilator, system operacyjny.

Dla programistów oznaczało to wyjście ponad poziom „fizycznego układania” algorytmów na kablach czy kartach. Nadal korzystano z kart jako nośnika wejścia, ale zasadnicza logika mogła być modyfikowana szybko i w pełni programowo. Zaczęły się pojawiać pierwsze języki symboliczne, które ukrywały surową postać kodu maszynowego.

Pamięci wczesnych komputerów – od linii opóźniających do bębnów magnetycznych

Aby program i dane mogły być przechowywane w tej samej przestrzeni, potrzebna była szybka pamięć robocza. W pierwszych konstrukcjach używano m.in.:

- linii opóźniających rtęciowych – fale dźwiękowe propagujące się w cieczy, w których informacja była przechowywana jako sekwencja impulsów,

- pamięci elektrostatycznej (np. lampy Williamsa) – ładunki przechowywane na powierzchni ekranu kineskopowego,

- bębnów magnetycznych – wirujących cylindrów z warstwą magnetyczną, na której zapisywano słowa maszynowe.

Te rozwiązania były technicznie złożone i wrażliwe na zakłócenia, ale dawały dostęp do danych z prędkością wystarczającą do sensownego działania maszyn lampowych. Pamięć główna była jednak bardzo droga, co przekładało się na projektowanie programów „pod ograniczenia sprzętowe”:

- dane musiały być pakowane w minimalną liczbę słów maszynowych,

- algorytmy projektowano tak, aby jak najrzadziej sięgać do wolniejszych nośników,

- program często był dzielony na segmenty, ładowane i wyładowywane w zależności od etapu obliczeń.

Takie realia wymuszały na programistach myślenie jednocześnie o logice algorytmu i kosztach dostępu do danych. Różne strategie, które współczesny programista może zignorować dzięki dużej pamięci RAM, wtedy decydowały o tym, czy program zadziała w rozsądnym czasie i czy w ogóle się zmieści.

Kod maszynowy i asembler – pierwszy krok ponad „gołe bity”

Pierwsze programy dla komputerów lampowych powstawały w kodzie maszynowym: sekwencjach liczb reprezentujących instrukcje. Programista musiał znać dokładne kody operacji (opcode), sposób adresowania pamięci i szczegóły organizacji rejestrów. Taki styl pracy był podatny na pomyłki i mało skalowalny.

Naturalnym krokiem było wprowadzenie języków asemblera. Zamiast zapamiętywać, że np. instrukcja dodawania to liczba o konkretnym kodzie, można było zapisać ją jako ADD. Zamiast adresów liczbowych używano etykiet symbolicznych, które asembler przeliczał na właściwe adresy.

Zyski były wielowymiarowe:

- spadło ryzyko błędów podczas ręcznego „liczenia adresów”,

- łatwiej było modyfikować i utrzymywać kod – przenoszenie fragmentu programu nie wymagało zmiany dziesiątek liczb adresowych,

- mogły powstawać makra – skróty zastępujące rozbudowane sekwencje instrukcji.

W kontekście efektywności pracy oznaczało to niższy koszt rozwoju oprogramowania na jednostkę funkcjonalności. Nadal jednak programista musił myśleć „blisko sprzętu”: znać rozmiar słowa maszynowego, układ pamięci, specyfikę urządzeń wejścia/wyjścia. Asembler był krokiem w górę, ale nie rozwiązywał problemu rosnącej złożoności systemów.