Po co wykrywać pętle w sieci i jaki jest praktyczny cel

Osoba odpowiedzialna za sieć zwykle nie ma czasu na teoretyczne wykłady, tylko musi możliwie szybko opanować sytuację: zdiagnozować, czy problemem jest pętla w sieci przełączników, ustabilizować środowisko i dopiero potem spokojnie posprzątać konfigurację. Klucz to zrozumienie podstaw działania STP, mechanizmów ochronnych takich jak BPDU Guard czy Root Guard oraz prostych technik diagnostycznych, które nie wymagają drogich narzędzi ani wymiany całego sprzętu.

Przy dobrze zaplanowanej topologii i kilku rozsądnych ustawieniach można znacząco zmniejszyć ryzyko awarii pętlowej, a jeśli już do niej dojdzie – skrócić czas przestoju z godzin do minut. Nie trzeba do tego „złotych” przełączników ani abonamentu na rozbudowany monitoring; ważniejsze są podstawowe zasady, checklisty i dyscyplina w okablowaniu.

Dlaczego pętle w sieci są groźne i jak je rozpoznać

Objawy pętli widziane oczami użytkownika i administratora

Pętla w sieci LAN to jeden z tych problemów, który „zjada” całą infrastrukturę na raz. Użytkownik widzi tylko to, że „internet nie działa”, aplikacje raz się łączą, raz nie, a telefonia VoIP przestaje dzwonić. Dla administratora objawy są bardziej konkretne, ale też łatwo je pomylić z innymi awariami.

Typowe symptomy, które z dużym prawdopodobieństwem wskazują na pętlę w warstwie 2:

- skok opóźnień w całej sieci, nie tylko do jednego serwera czy usługi,

- pakiety ICMP (ping) gubią się losowo – raz odpowiedź jest, raz nie, nawet w obrębie tej samej podsieci,

- użytkownicy nie dostają adresów z DHCP, mimo że serwer działa,

- okresowe utraty połączenia z kontrolerem domeny, serwerami plików, VoIP, drukarkami sieciowymi,

- zawieszające się sesje RDP i VPN, mimo że łącze do internetu jest stabilne.

Od strony administratora bardzo charakterystyczne są informacje z samych przełączników: wysoki poziom obciążenia CPU, niemal 100% ruchu na licznikach interfejsów, logi pełne informacji o zmianach topologii STP, portach przechodzących w err-disable, a czasem nawet utrata możliwości zalogowania się na switch przez SSH/Telnet, bo zarządza nim ten sam zapchany plan kontrolny.

W praktyce pętla często zaczyna się niewinnie. Przykładowy scenariusz: ktoś na sali konferencyjnej znalazł w szafce krótki patchcord, połączył nim dwa gniazda „bo światłowód nie działa” albo „żeby przyspieszyć internet”. Gniazda prowadzą do tego samego switcha albo dwóch switchy dostępnych w tej samej pętli. Po kilkudziesięciu sekundach broadcasty zaczynają krążyć w kółko i cały budynek zwalnia do zera.

Co dzieje się na przełącznikach podczas pętli

Aby świadomie diagnozować pętle, trzeba rozumieć, co się dzieje pod maską. Przełączniki warstwy 2 działają na podstawie tablic MAC. Gdy ramka trafi na port, switch zapamiętuje źródłowy adres MAC i port, a następnie wysyła ramkę albo na konkretny port (jeśli zna MAC docelowy), albo jako broadcast/flooding, jeśli nie zna odbiorcy.

W przypadku pętli topologicznej ramka trafia na port A, wychodzi przez port B do kolejnego switcha, z którego wraca z powrotem inną ścieżką na port C tego samego urządzenia. Switch widzi tę samą ramkę w kółko, aktualizuje wpisy w tablicy CAM, przerzucając adres MAC między portami, generuje dodatkowe broadcasty, a ruch zaczyna się multiplikować. Nie ma tu mechanizmu TTL jak w IP, więc ramka może krążyć „wiecznie”, dopóki coś nie przerwie ścieżki.

Skutki na poziomie przełączników:

- CPU swicha rośnie, bo procesy odpowiedzialne za STP, obsługę tablicy MAC i plan kontrolny dostają zalew zdarzeń,

- tablica MAC jest ciągle przepisywana, co powoduje kolejne fale floodingów,

- włączają się mechanizmy obronne (jeśli są skonfigurowane): BPDU Guard, Loop Guard, STP zaczyna przełączać ścieżki,

- czasem switch może się zresetować z powodu przeciążenia, a po restarcie pętla pojawia się ponownie, bo fizyczne połączenie się nie zmieniło.

Jeśli pętla obejmuje kilka switchy, problem rozlewa się na większą część sieci. Ramki broadcast i multicast są powielane w każdym segmencie, a każdy kolejny przełącznik dorzuca swoje informacje (np. BPDU, CDP/LLDP, ARP). Niewielka lokalna pętelka przy jednym biurku potrafi skutecznie unieruchomić sieć całej firmy.

Różnica między pętlą a „zwykłym” dużym ruchem

Dla kogoś, kto patrzy tylko na graficzny wykres z monitoringu, pętla wygląda jak gwałtowny skok ruchu w całej sieci. Łatwo to pomylić z atakiem DDoS albo problemem operatora ISP. Kluczowe są detale:

- w pętli opóźnienia i utraty pakietów widać także przy połączeniach wewnątrz tej samej podsieci, między dwoma hostami za tym samym przełącznikiem,

- łącze do internetu może wcale nie być wysycone – przeciążenie widać głównie na uplinkach między switchami,

- duży „zwykły” ruch zwykle pochodzi z jednego lub kilku hostów, pętla generuje zalew broadcastów i multicastów z wielu źródeł.

Przy pętli zwykle pojawia się też bardzo charakterystyczny obraz diod na przełączniku: bardzo szybkie, niemal ciągłe miganie na większości portów, także na tych, które normalnie są mało aktywne. Dodatkowo logi STP mogą pokazywać częste zmiany topologii (topology change) – to mocny sygnał, że problem dotyczy warstwy 2, a nie np. przeciążonego serwera www.

Podstawy STP – po co jest i jak działa na tyle, żeby nie dać się zaskoczyć

Koncepcja drzewa rozpinającego w prostych słowach

STP (Spanning Tree Protocol) to mechanizm, który ma jeden główny cel: usunąć pętle w topologii warstwy 2, nie wycinając fizycznych połączeń. Sieć może mieć wiele ścieżek między przełącznikami, ale STP logicznie wybiera jedną strukturę drzewa: od centralnego punktu (root bridge) do wszystkich pozostałych switchy.

W tej logice każde połączenie jest oceniane pod kątem „kosztu” ścieżki do root bridge. Na podstawie tych kosztów STP:

- wybiera główną drogę (najniższy koszt) z każdego swicha do root bridge,

- pozostałe redundantne łącza blokuje na poziomie warstwy 2 – porty są w stanie blocking lub analogicznym, zależnie od wariantu STP,

- jeśli gdzieś łącze padnie, STP przelicza topologię i odblokowuje wcześniej „zaparkowaną” ścieżkę.

W efekcie sieć z wieloma fizycznymi połączeniami działa jak drzewo: od korzenia do liści tylko jedną ścieżką, bez cykli. To drastycznie zmniejsza ryzyko pętli, ale wprowadza też dodatkową złożoność i opóźnienia przy rekonwergencji po awarii. Dlatego warto znać przynajmniej podstawowe stany portów i zasady wyboru root bridge, aby nie być zakładnikiem domyślnej konfiguracji.

Rola root bridge i świadome jego planowanie

Root bridge (most korzeń) to centralny punkt odniesienia dla całego STP. Wszystkie koszty ścieżek są liczone względem niego. W prostych słowach: to „szef” drzewa rozpinającego. Wybór root bridge ma bezpośredni wpływ na to, którędy będzie biegł ruch, jakie porty zostaną zablokowane i jak sieć będzie reagować na awarie.

Wybór odbywa się automatycznie na podstawie priorytetu mostu (bridge priority) i adresu MAC. Niższy priorytet oznacza wyższe uprzywilejowanie. Jeśli wiele switchy ma ten sam domyślny priorytet, root bridge zostaje urządzenie z najniższym adresem MAC. To oznacza, że przy braku planowania rootem może zostać przypadkowy, mały switch dostępowy w szafce w magazynie, bo producent dał mu mniejszy MAC.

Świadome podejście:

- wyznaczyć 1–2 centralne przełączniki (dystrybucja/core) jako kandydatów na root bridge,

- ustawić im niższy priorytet STP niż pozostałym (np. 4096 lub 8192 zamiast domyślnych 32768),

- w pozostałych switchach można nawet podnieść priorytet, żeby zmniejszyć szanse na nieplanowany wybór,

- monitorować logi, czy root bridge nie zmienia się niespodziewanie – jeśli tak, od razu sprawdzić, co za nowy switch pojawił się w sieci.

Takie ustawienie nic nie kosztuje poza kilkoma minutami pracy, a pozwala uniknąć sytuacji, w której tani switch od użytkownika narzuca całej sieci nowe drzewo STP, wydłuża ścieżki i zwiększa ryzyko pętli.

Stany portów STP i wpływ na przepływ ruchu

Porty uczestniczące w STP przechodzą przez kilka stanów. Znajomość tych etapów pomaga zrozumieć, dlaczego po wpięciu nowego kabla sieć przez chwilę „zastanawia się”, zanim ruch zacznie normalnie przepływać.

- Blocking – port nie przepuszcza danych użytkowników, tylko słucha BPDUs; stan ochronny przeciw pętlom.

- Listening – port bierze udział w STP, ale nadal nie przepuszcza danych; analizuje BPDUs i buduje drzewo.

- Learning – port zaczyna uczyć się adresów MAC, ale jeszcze nie przepuszcza ruchu użytkowników.

- Forwarding – normalna praca, ruch przechodzi, port uczestniczy w STP.

- Disabled – port administracyjnie wyłączony lub w stanie błędu (err-disable).

W klasycznym STP zmiana stanu portu po podłączeniu kabla może trwać kilkadziesiąt sekund. To dlatego nowe połączenie sieciowe potrafi „ożyć” z wyraźnym opóźnieniem. W nowocześniejszych wariantach (RSTP) proces jest znacznie szybszy, ale logika ochrony przed pętlami pozostaje podobna.

Znajomość stanów pomaga też przy diagnostyce. Jeśli widać, że port łączący dwa switche jest ciągle w stanie blocking, trzeba sprawdzić, czy nie jest to redundantne połączenie, które STP słusznie zablokował, aby nie doszło do pętli. Jeśli natomiast port brzegowy (do użytkownika) nagle przechodzi w err-disable po wykryciu BPDU, to sygnał, że na brzegu pojawił się nowy switch lub inne niepożądane urządzenie.

Koszty ścieżek i priorytety – tylko tyle, ile trzeba

Cała magia STP działa na podstawie kosztów ścieżek i priorytetów. Dla administratora, który chce utrzymać sieć bez pętli i bez niepotrzebnych komplikacji, najważniejsze są dwie rzeczy:

- koszt portu zwykle zależy od szybkości łącza (niższy przy 10 Gb/s, wyższy przy 1 Gb/s itd.),

- sumaryczny koszt ścieżki to suma kosztów portów od danego switcha do root bridge.

Dzięki temu STP naturalnie preferuje szybsze łącza jako główne ścieżki. W małych i średnich sieciach rzadko trzeba ręcznie zmieniać koszty; ważniejsze jest odpowiednie ustawienie priorytetu root bridge. Zmiana kosztów może być użyteczna, jeśli chcemy wymusić konkretną drogę dla ruchu (np. preferować jedno z dwóch równoległych łączy między budynkami), ale to już krok dla bardziej świadomej administracji i najlepiej mieć to udokumentowane.

STP, RSTP, MSTP – porównanie efekt vs wysiłek

Na rynku funkcjonuje kilka wariantów protokołu drzewa rozpinającego. Z punktu widzenia małej lub średniej sieci ważne są różnice praktyczne, a nie pełna teoria.

| Wariant | Główna cecha | Zastosowanie |

|---|---|---|

| STP (802.1D) | Wolna rekonwergencja, prosta logika | Małe, stare instalacje, sprzęt bez wsparcia nowszych protokołów |

| RSTP (802.1w) | Szybka rekonwergencja, kompatybilny w dół | Domyślny wybór dla większości małych i średnich sieci |

| MSTP (802.1s) | Wiele drzew STP dla różnych VLAN-ów | Większe sieci, złożone scenariusze, campus |

Dla sieci o budżetowym charakterze RSTP zwykle daje najlepszy stosunek możliwości do wysiłku: działa szybciej niż klasyczny STP, nie wymaga skomplikowanej konfiguracji, a większość przełączników zarządzalnych go obsługuje. MSTP ma sens dopiero wtedy, gdy naprawdę trzeba optymalizować ścieżki osobno dla grup VLAN-ów, np. w większym kampusie czy hotelu z wieloma strefami.

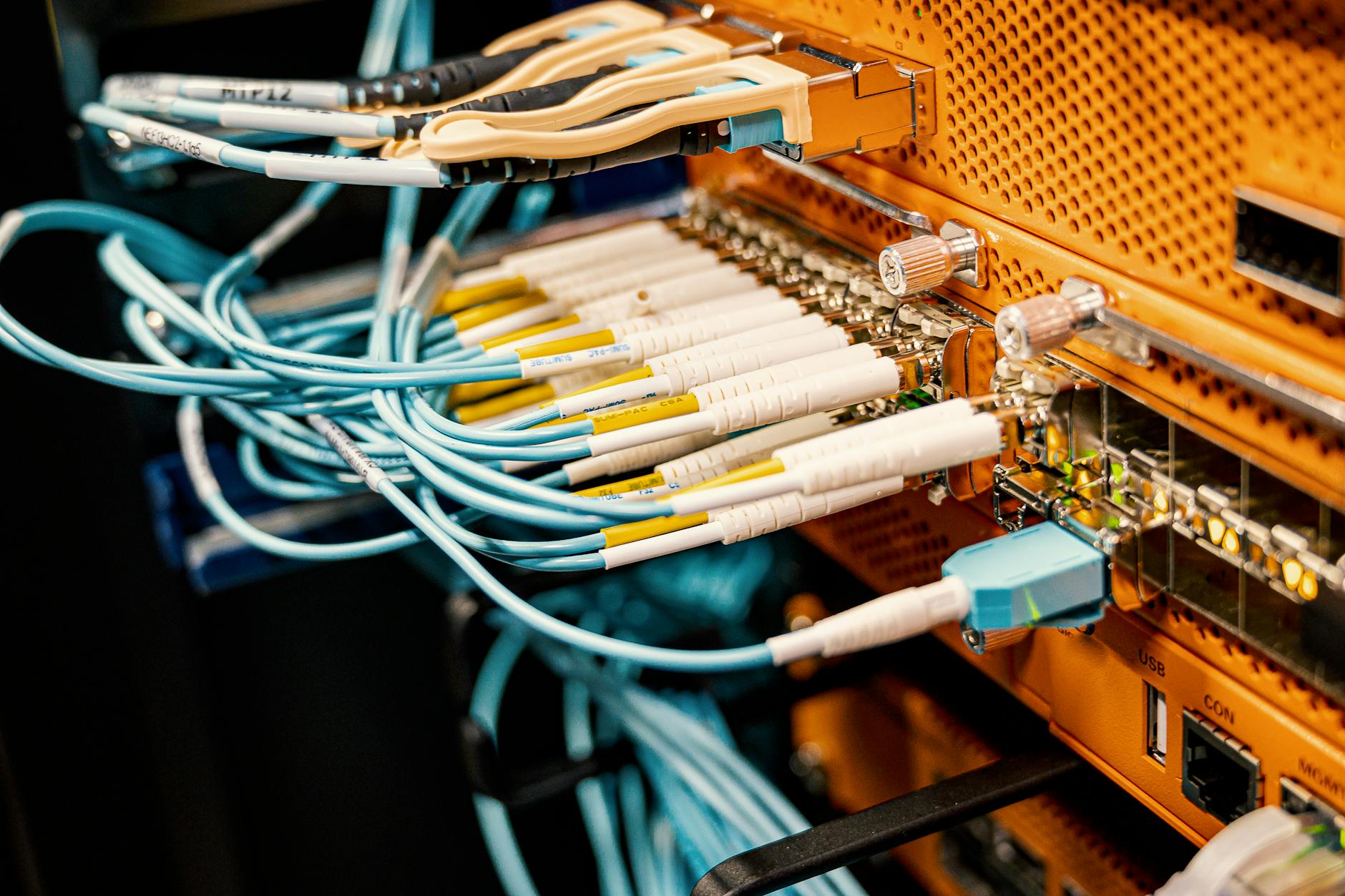

BPDU, BPDU Guard i pokrewne mechanizmy ochronne – jak zabezpieczyć brzegi sieci

Czym są BPDU i dlaczego pojawienie się ich na brzegu to sygnał alarmowy

BPDU (Bridge Protocol Data Unit) to specjalne ramki używane przez STP do wymiany informacji między przełącznikami: kto jest root bridge, jakie są koszty ścieżek, które porty mają być blokowane. W idealnym scenariuszu BPDU widzisz wyłącznie na łączach między switchami i ewentualnie między switchami a innymi urządzeniami L2 (np. kontrolerami, niektórymi firewallami).

Na portach brzegowych – tych, do których podpinasz laptopy, drukarki, access pointy czy kamery – BPDU nie są potrzebne. Co więcej, pojawienie się tam BPDUs oznacza, że:

- ktoś podpiął dodatkowy przełącznik (czasem mały „domowy” switch za 50 zł),

- na kablu jest inne urządzenie warstwy 2 zdolne do mówienia STP,

- może gubi się dokumentacja i powstało nieplanowane połączenie między segmentami.

Jeśli takie urządzenie zacznie uczestniczyć w STP, może w skrajnym przypadku przebić się na root bridge, zmienić topologię i zwiększyć ryzyko pętli. Dlatego log typu „received BPDU on edge port” na switchu dostępowym to powód, żeby przynajmniej rzucić okiem do szafy lub do pokoju użytkownika.

BPDU Guard – najprostszy „bezpiecznik” na porty brzegowe

BPDU Guard to jeden z najtańszych i najskuteczniejszych mechanizmów ochronnych w STP. Jego zadanie jest proste: jeśli port oznaczony jako brzegowy (edge / portfast) nagle zobaczy BPDU, zostaje automatycznie wyłączony (najczęściej w stanie err-disable).

Jak to wygląda praktycznie:

- port pracuje normalnie, użytkownik ma dostęp do sieci,

- ktoś wpina w to gniazdko tani switch albo pętlę z powrotem do innego gniazda ściennego,

- switch główny widzi BPDU na porcie oznaczonym jako edge,

- BPDU Guard blokuje ten port – pętla zostaje odcięta zanim rozbije całą sieć.

Efekt vs wysiłek:

- Efekt: automatyczne odcięcie potencjalnej pętli na brzegu, mniej awarii „bo ktoś coś przepiął”.

- Wysiłek: kilka komend na switchu albo włączenie opcji globalnie (np. „bpduguard default” i oznaczenie portów jako edge/portfast).

W praktyce najlepiej połączyć BPDU Guard z oznaczeniem portów użytkowników jako edge/portfast, żeby dodatkowo skrócić czas ich aktywacji. Przy typowych przełącznikach zarządzalnych klasy „SOHO+/SMB” masz to dostępne od ręki, bez dodatkowych licencji.

BPDU Filter, Root Guard, Loop Guard – kiedy mają sens, a kiedy lepiej odpuścić

Oprócz BPDU Guard dostępne są inne mechanizmy, które pomagają trzymać STP pod kontrolą. Nie wszystkie są potrzebne w każdej małej sieci, ale świadomość ich działania pozwala uniknąć złych decyzji konfiguracyjnych.

BPDU Filter

BPDU Filter może mieć dwa oblicza, zależnie od producenta i sposobu włączenia:

- na portach brzegowych – filtruje wysyłanie/odbieranie BPDUs, ale często zachowuje podstawową ochronę (np. po zobaczeniu BPDU port przestaje być edge),

- w trybie globalnym – może całkowicie wyłączyć udział portu w STP.

Dla większości budżetowych instalacji dużo rozsądniej jest nie kombinować z BPDU Filter i trzymać się prostego zestawu: STP/RSTP + portfast/edge + BPDU Guard. Niewłaściwe użycie BPDU Filter potrafi „okaleczyć” STP na danym porcie, czyli odebrać sieci ostatnią linię obrony przed pętlą.

Root Guard

Root Guard przydaje się tam, gdzie nie chcesz, aby określony port kiedykolwiek stał się drogą do nowego root bridge. Typowy przypadek: masz centralny switch core/dystrybucję ustawiony jako root, a do niego wpinasz sprzęt od zewnętrznego dostawcy (np. urządzenia operatora, switch najemcy). Na takim porcie można włączyć Root Guard, żeby:

- nawet jeśli ten zewnętrzny switch będzie miał niższy priorytet STP, nie przejął roli root bridge,

- port wszedł w stan ochronny, jeśli pojawi się na nim BPDU „kandydata” na root.

W małych sieciach bez wydzielonych domen administracyjnych Root Guard często jest zbędny. Jeśli jednak łączysz się z kilkoma niezależnymi systemami (np. sieć firmowa + sieć najemcy + sprzęt operatora), Root Guard na granicach to tani sposób na utrzymanie kontroli.

Loop Guard

Loop Guard zabezpiecza przed rzadkim, ale bolesnym scenariuszem: port blocking nagle przestaje dostawać BPDU (np. z powodu jednostronnej awarii łącza), uznaje, że ścieżka się zmieniła, przechodzi w forwarding i w efekcie tworzy się pętla. Loop Guard pilnuje, żeby takie porty nie „budziły się” bez pewności, że topologia nadal jest spójna.

W małych, prosto zbudowanych sieciach (gwiazda, kilka switchy) korzyść z Loop Guard bywa skromna, ale jeśli masz:

- wiele redundantnych łączy między tymi samymi switchami,

- łącza radiowe lub światłowody z konwerterami mediowymi, które lubią zamilknąć tylko w jedną stronę,

to Loop Guard potrafi uratować dzień. Konfiguracja najczęściej jest globalna lub per-port i sprowadza się do przełączenia jednej opcji.

Gdzie włączyć ochronę STP, żeby było bezpiecznie i nie przeinwestować

Najrozsądniejsze podejście w małej/średniej sieci wygląda zwykle tak:

- Na portach brzegowych (do użytkowników, drukarek, kamer, AP):

włącz RSTP, oznacz porty jako edge/portfast, dodaj BPDU Guard. To zabezpiecza przed „sprytnym” użytkownikiem z własnym switchem i przed nieświadomym spięciem gniazd patchcordem. - Na uplinkach między switchami:

zostaw pełne STP, nie włączaj portfast, możesz rozważyć Loop Guard przy bardziej złożonej topologii. Root Guard na uplinku do sprzętu obcego administratora też ma sens. - Na łączach do operatora i cudzych systemów:

zależnie od ustaleń: albo wyłączasz STP i traktujesz łącze jak „czarne pudełko” (dotyczy głównie połączeń L3), albo zostawiasz STP, ale z Root Guard i dokumentacją, kto po drugiej stronie za to odpowiada.

Klucz w tym, żeby nie próbować „upiększać” każdej opcji na przełączniku. Dwie–trzy dobrze dobrane funkcje (portfast/edge, BPDU Guard, ewentualnie Root/Loop Guard na konkretnych portach) dają dużo większy efekt niż rozbudowane kombinacje, których nikt później nie rozumie.

Najczęstsze scenariusze powstawania pętli w realnych sieciach

Domowy switch użytkownika i „sprytne” przedłużanie gniazdek

W wielu biurach najbardziej typowym źródłem pętli jest mały, niezarządzalny switch kupiony przez użytkownika. Motywacja bywa prosta: „Mam jedno gniazdko w ścianie, a potrzebuję podpiąć trzy urządzenia”. Użytkownik wpina switch w gniazdko, potem z tego switcha wychodzi z powrotem do innego gniazdka w pokoju lub na korytarzu. Nagle te dwa gniazda, które miały kończyć się w patchpanelu na różnych portach przełącznika, są spięte razem.

Takie spięcie nie ma STP po drodze, więc jeśli po stronie infrastruktury coś jest źle skonfigurowane (brak STP, błędne tryby portów), pętla staje się natychmiastowa. Objaw: lawina broadcastów, wyraźne „zawieszenie” sieci na całym piętrze, a czasem w całym budynku.

Najprostsza obrona: RSTP włączone wszędzie oraz BPDU Guard + edge na portach do użytkowników. Nawet jeśli użytkownik wpiąłby zarządzalny switch, który mówi STP, port się zablokuje, a problem zostanie zawężony do jednego pokoju.

Pętla przez źle spatchowane gniazda i panele

Drugi klasyk to błąd przy patchowaniu: technik w szafie łączy dwa porty tego samego przełącznika albo dwa różne przełączniki dodatkowym przewodem, nie wiedząc, że łącze redundantne jest już zapewnione. Czasem winne jest oznaczenie kabli albo pośpiech przy montażu.

Przykład z praktyki: firma ma dwa przełączniki na piętrze połączone uplinkiem. Nowy technik widzi wolne porty SFP i postanawia „poprawić redundancję”, dorzucając drugie łącze miedziane bez agregacji, „bo tak będzie szybciej działać”. Jeśli STP jest wyłączone lub błędnie skonfigurowane (np. połączenie trunk/access bez pełnego udziału w STP), pojawia się twarda pętla między urządzeniami.

Tu pomagają:

- aktywny RSTP na wszystkich połączeniach między switchami,

- prosta polityka: żadne nowe łącze między przełącznikami bez sprawdzenia dokumentacji i krótkiej analizy STP,

- oznaczenia kabli i krótka instrukcja obok szafy („Nie łącz portów tego samego switcha ze sobą”).

Access point z wbudowanym switchem lub zasilaniem w trybie passthrough

Niektóre access pointy mają więcej niż jeden port Ethernet albo oferują tryb passthrough PoE. W praktyce użytkownik może wpiąć AP do gniazdka, a z drugiego portu AP wyjść dalej – do kolejnego gniazda lub urządzenia. Jeśli końcówka tej ścieżki wróci do tego samego przełącznika inną drogą, powstaje pętla, której źródło trudno znaleźć, bo na pierwszy rzut oka „tylko AP jest wpięty”.

Dlatego przy AP dobrze sprawdza się:

- jasna zasada, że z portów „passthrough” nie korzysta się do przedłużania sieci strukturalnej,

- dokładne opisanie, które gniazda służą wyłącznie do zasilania AP,

- monitoring MAC/LLDP na portach – jeśli za AP nagle pojawiają się kolejne urządzenia L2, to znak, że ktoś użył go jako „cichego switcha”.

Pętle w sieciach z wieloma VLAN-ami i źle skonfigurowanymi trunkami

W bardziej rozbudowanych sieciach, gdzie jest kilka VLAN-ów, pętle potrafią powstawać tylko w jednym z nich. Bywa, że:

- jeden z uplinków jest skonfigurowany jako trunk, drugi jako access,

- STP działa tylko na części VLAN-ów (np. PVSTP, MSTP z błędnie zmapowanymi instancjami),

- na jednym z przełączników wyłączono STP „bo przeszkadzało w testach”.

Efekt jest taki, że w jednym VLAN-ie STP poprawnie blokuje redundantny port, a w innym tej ochrony brakuje i pętla spiraluje wyłącznie tam. Objawem może być np. to, że kamery IP (osobny VLAN) przestają działać, a sieć biurowa ma się dobrze. Diagnostyka jest trudniejsza, bo nie „pada wszystko naraz”.

Minimum higieny:

- jeden, spójny wariant STP na całej domenie (np. wszędzie RSTP lub konsekwentnie MSTP),

- żadnych „wyłączeń STP na chwilę” na trunkach między przełącznikami,

- prosty schemat VLAN-ów bez przesadnego dzielenia na dziesiątki segmentów, jeśli nie ma ku temu twardych powodów.

Pętle na urządzeniach „nietypowych”: media konwertery, mosty bezprzewodowe, IoT

Urządzenia, które z pozoru są „przezroczyste”, często nie mają pełnego wsparcia STP. Media konwerter, tani most radiowy, inteligentny kontroler budynku – wszystko to potrafi przekazywać ramki warstwy 2 bez żadnego pojęcia o BPDU i pętlach.

Przykładowy scenariusz: dwa budynki połączone są mostem radiowym, a równolegle ktoś kładzie dodatkowy kabel miedziany „na wszelki wypadek”. Jeśli oba łącza są aktywne i STP po jednej ze stron jest wyłączone lub zablokowane przez nietypowe urządzenie pośrednie, pojawia się pętla, którą ciężko „zobaczyć” na pierwszy rzut oka.

Rozsądne podejście:

- tam, gdzie w torze jest urządzenie nieświadome STP, z obu stron musi pracować poprawnie STP/RSTP,

- jeśli nie da się tego zapewnić – nie tworzyć równoległych łączy, chyba że w pełni kontrolujesz agregację na switchach,

- przy planowaniu takich łączy dodać do dokumentacji prosty rysunek z zaznaczonymi urządzeniami „nie-STP”.

Szybka diagnostyka pętli – co sprawdzić w pierwszych 5–15 minutach

Ocena objawów: czy to na pewno pętla, a nie tylko „ciężki” serwer

Na starcie dobrze oddzielić klasyczne przeciążenie serwera lub łącza od typowej burzy broadcastowej. Kilka krótkich obserwacji pozwala szybko wstępnie ocenić sytuację:

- LED-y na switchach: większość portów miga bardzo szybko, często bez przerwy, także tam, gdzie zwykle ruch jest minimalny.

Krótka checklista na przełączniku: STP, CPU i tablica MAC

Jeżeli podejrzewasz pętlę, najlepiej od razu „zajrzeć” do jednego ze switchy, który jest w środku problemu. Zwykle da się to zrobić zdalnie, zanim wszystko całkiem padnie.

- Zużycie CPU na przełączniku: jeśli nagle rośnie do 80–100% i utrzymuje się, a nic ciężkiego nie było wdrażane – to mocny sygnał, że coś jest nie tak z ruchem L2.

- Tablica MAC (CAM): przy pętli adresy MAC potrafią „skakać” między portami – jeden MAC widziany raz na porcie 10, za chwilę na 18. Na większości urządzeń pokaże to prosty podgląd tablicy i filtrowanie po konkretnym MAC.

- STP state: sprawdzenie, czy nie ma portów, które dopiero co przeszły z blocking do forwarding, albo takich, które są w stanie err-disable przez BPDU Guard. Często log STP od razu wskaże, który port rozpoczął zamieszanie.

Jeśli masz ograniczony czas, celuj w te trzy rzeczy. Nie wymaga to zaawansowanej wiedzy o STP, a już pozwala odróżnić „ciężki backup” od burzy broadcastowej.

Szybki rzut okiem na logi: co mówi STP i BPDU Guard

Przy dobrze włączonych mechanizmach ochronnych logi często praktycznie prowadzą za rękę. W pierwszych minutach konfliktu warto sprawdzić:

- komunikaty o zmianach topologii STP (topology change): jeśli pojawiają się seryjnie co kilka sekund, a wcześniej były rzadkie, jest duża szansa na pętlę lub flapping łącza,

- zdarzenia z BPDU Guard: wpis typu „port disabled due to BPDU Guard” zwykle wskazuje dokładnie, w którym pokoju lub na którym patchpanelu ktoś dołożył „sprytny” element,

- alerty o broadcast storm / storm-control: jeśli masz włączony storm control, log pokaże, które porty przekroczyły próg.

W praktyce, gdy dzwoni helpdesk z informacją „całe piętro leży”, szybkie show log albo podgląd zdarzeń w GUI często wystarczy, by zawęzić poszukiwania do jednego lub dwóch portów.

Izolowanie problemu: wyłączanie całych segmentów zamiast pojedynczych kabli

Przy dużej liczbie kabli i ograniczonym czasie łatwiej jest wyłączać całe grupy portów niż polować na jeden feralny patchcord. Szczególnie gdy nie ma dobrej dokumentacji.

Prosty, mało inwazyjny schemat:

- jeśli masz kilka przełączników na piętrze – najpierw odłącz ich uplinki jeden po drugim, obserwując, czy burza broadcastowa się uspokaja,

- gdy okaże się, że problem siedzi w jednym switchu – na nim grupowo wyłącz porty użytkowników (np. połowę numeracji), sprawdź, czy objawy mijają; jeśli tak, zawęź do mniejszej grupy,

- używaj oznaczeń portów (opisy w konfiguracji, naklejki przy patchpanelu), żeby z grubsza wiedzieć, które kable wycinasz – zwykle lepiej na chwilę odciąć jeden dział niż całe piętro.

Takie „dzielenie problemu na pół” jest szybsze niż bieganie po pokojach. W wielu firmach to jedyna metoda, którą da się zastosować w rozsądnym czasie, gdy nikt wcześniej nie zainwestował w porządne opisy okablowania.

Proste narzędzia i sztuczki „z budżetem zero”

Nawet bez drogich systemów monitoringu da się zrobić kilka praktycznych rzeczy:

- Ping w kółko do kilku hostów w różnych VLAN-ach: uruchom z laptopa lub z samego switcha (jeśli potrafi). Gdy pojawia się pętla, odpowiedzi zaczynają być mocno nieregularne lub znikają falami, często równocześnie z szybką pracą LED-ów.

- Podgląd liczby broadcastów/multicastów per port: w CLI lub prostym GUI zobaczysz, które porty generują nienaturalnie dużo takich ramek. To często główny „winowajca”.

- Fizyczny „objazd” szaf z obserwacją diod: na jednym piętrze widać zwykle, który switch świeci się jak choinka, a które spokojniej. Nawet przy braku dostępu do konfiguracji to pomaga wskazać, gdzie zacząć odłączanie.

Wiele małych firm nie ma dedykowanego NMS, ale kilka prostych komend i obserwacja LED-ów wystarczają, by w 10–15 minut przynajmniej odseparować problem i przywrócić podstawowe działanie sieci.

Jak nie zrobić sobie gorzej: minimalnie inwazyjne działania ratunkowe

Stres przy awarii często kusi do ruchów typu „wyłączmy STP, będzie mniej kombinował”. To jedna z najdroższych w skutkach decyzji, jakie można podjąć.

Bezpieczniejsze, szybsze rozwiązania awaryjne to m.in.:

- czasowe wyłączenie pojedynczych uplinków redundantnych, zamiast grzebania w konfiguracji STP – lepiej na chwilę stracić redundancję niż całe L2,

- przełączenie kilku najbardziej newralgicznych portów w stan administracyjnie „down”, ale bez kasowania ich konfiguracji – po opanowaniu sytuacji łatwo je włączyć z powrotem,

- tymczasowe odcięcie problematycznego segmentu (np. jedno skrzydło budynku) na poziomie jednego trunku, zamiast wyłączania dziesiątek portów po kolei.

Konfiguracji STP lepiej nie ruszać „na gorąco”, jeśli nie ma się pełnego obrazu topologii. Szybsze i bezpieczniejsze jest fizyczne lub logiczne (shutdown portu) odcięcie podejrzanych fragmentów sieci.

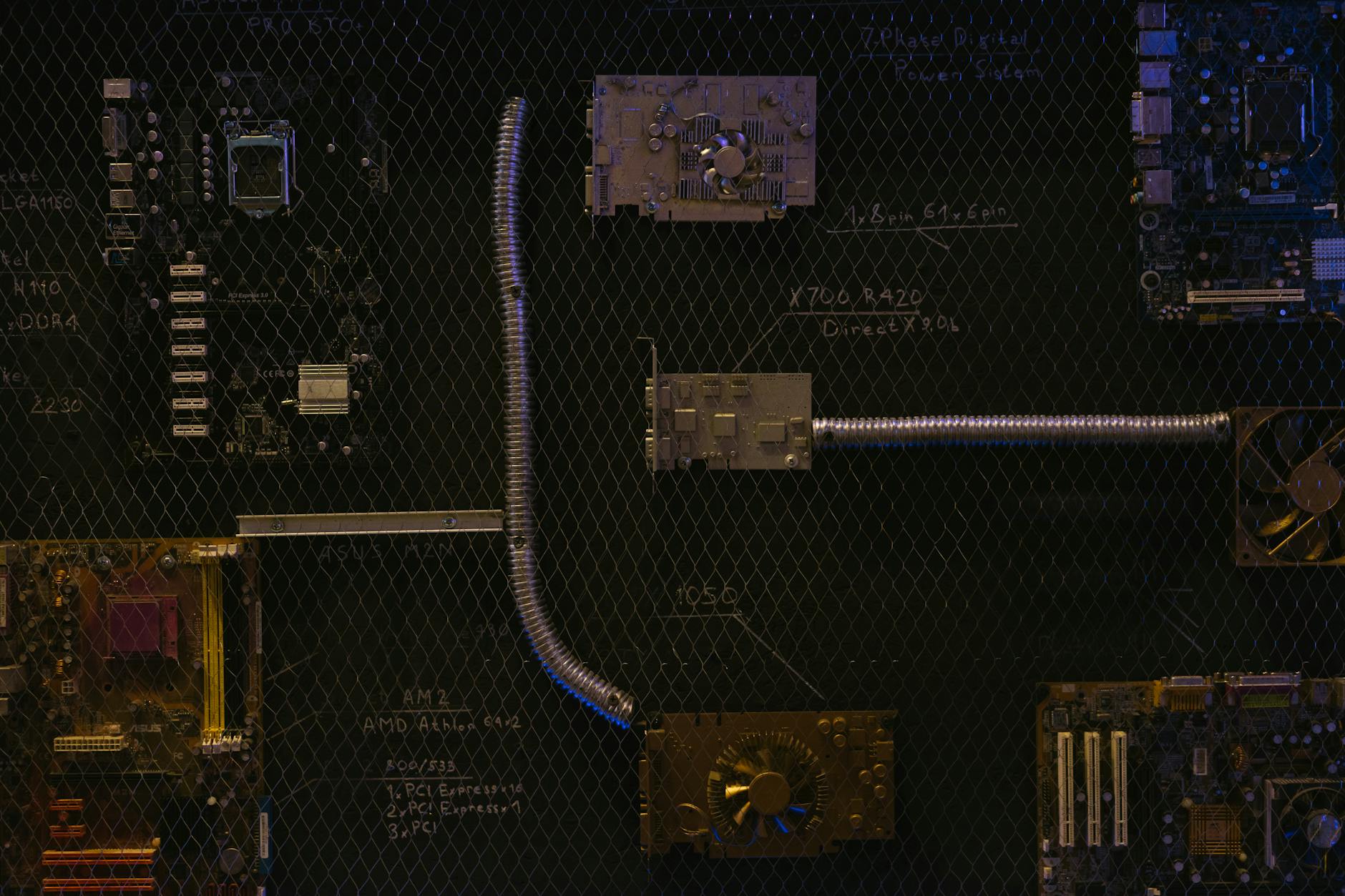

Tanie elementy, które przyspieszają diagnozę przy kolejnej awarii

Po pierwszej walce z pętlą często okazuje się, że godzinę straciło się nie na samą naprawę, ale na szukanie, gdzie w ogóle zacząć. Kilka drobnych usprawnień znacząco skraca późniejsze akcje serwisowe i nie wymaga dużego budżetu.

- Opisy portów w konfiguracji: wpisanie przy porcie krótkiej informacji typu „Biuro 3.12, gniazdo A” kosztuje kilka minut przy wdrożeniu, a przy awarii od razu wiadomo, gdzie iść.

- Prosta tabela VLAN <-> przełącznik: arkusz z listą VLAN-ów i informacją, na których switchach występują. Dzięki temu przy problemach w jednym VLAN-ie od razu wiadomo, które urządzenia odpadają z diagnozy.

- Naklejki na patchpanelu i przy przełączniku: numeracja portów i krótki opis funkcji (uplink, połączenie do operatora, kamera, AP). To groszowe sprawy, a drastycznie zmniejszają ryzyko „dodatkowego” kabla wpiętego nie tam, gdzie trzeba.

Takie działania wpisują się dobrze w podejście „efekt vs wysiłek”: ani nie kosztują dużo, ani nie wymagają skomplikowanych narzędzi, a przy każdej kolejnej awarii skracają czas reakcji o kilkanaście minut.

Automatyczne zabezpieczenia „z pudełka”, które warto włączyć przynajmniej na rdzeniu

Jeśli korzystasz ze switchy z choćby podstawowymi funkcjami L2, część ochrony przed pętlami i burzami broadcastowymi da się uzyskać jednym poleceniem, zwłaszcza w warstwie dystrybucyjnej/rdzeniowej.

- Storm control na broadcast/multicast: ustawienie limitu procentowego ruchu broadcast na portach uplinkowych. Po przekroczeniu progu switch zaczyna ograniczać ruch, co często pozwala „oddychać” reszcie sieci.

- Auto err-disable recovery: włączenie automatycznego przywracania portów zablokowanych przez BPDU Guard po określonym czasie. Chroni to przed sytuacją, w której jedno zdarzenie na porcie użytkownika wymaga ręcznego logowania się na switch.

- Syslog lub e-mail z alertami STP: nawet tani syslog na małym serwerze lub NAS-ie wystarczy, żeby mieć historię, kiedy i które porty powodowały zmiany topologii.

Jeśli budżet jest ciasny, sensownie jest włączyć takie funkcje najpierw na przełącznikach centralnych. Tam każda pętla najbardziej boli, a każda minuta szybciej wykrytej awarii przekłada się na mniejszy chaos w całej organizacji.

Najczęściej zadawane pytania (FAQ)

Jak rozpoznać pętlę w sieci LAN w praktyce?

Typowy obraz z punktu widzenia użytkownika to „raz działa, raz nie”: strony otwierają się losowo, VoIP przestaje dzwonić, logowanie do domeny się wiesza, a drukarki sieciowe znikają z listy. Problemy występują jednocześnie w wielu aplikacjach i na wielu stanowiskach, często w całym budynku.

Administrator widzi zwykle skok obciążenia CPU na switchach, prawie 100% ruchu na wielu portach, losowe utraty odpowiedzi na ping w tej samej podsieci oraz logi pełne komunikatów STP (częste topology change, porty przechodzące w err-disable). Dodatkowy „sygnał alarmowy” to niemal ciągłe, szybkie miganie diod na większości portów, także tych, które zwykle są spokojne.

Jak szybko sprawdzić, czy mam pętlę w warstwie 2, bez drogich narzędzi?

Na start wystarczy kilka prostych kroków: ping między dwoma hostami w tej samej podsieci (bez wychodzenia do internetu), podgląd obciążenia CPU i liczników interfejsów na switchach oraz przejrzenie logów STP. Jeśli opóźnienia i loss pojawiają się już w sieci lokalnej, a uplinki między przełącznikami są wysycone, to mocny kandydat na pętlę.

Drugie tanie narzędzie to „odłączanie z głową”: fizyczne wyjmowanie podejrzanych patchcordów (sale konferencyjne, gniazda przy biurkach, dodatkowe małe switche „od użytkownika”) i obserwacja, czy sytuacja się stabilizuje. Zajmuje to zwykle kilkanaście minut, nie wymaga żadnego dodatkowego oprogramowania, a w praktyce rozwiązuje większość incydentów spowodowanych pętlami.

Czym jest STP i czy naprawdę muszę je włączać w małej sieci?

STP (Spanning Tree Protocol) to mechanizm, który z wielu fizycznych połączeń między switchami tworzy logiczne drzewo bez pętli. Wybierany jest jeden root bridge (switch „centralny”), a redundantne łącza są automatycznie blokowane, dopóki nie będą potrzebne przy awarii. Dzięki temu ramki nie krążą w nieskończoność.

Nawet w małej firmie z kilkoma przełącznikami jedno „głupie” spięcie dwóch gniazd w sali może położyć całą sieć. Włączenie STP nic nie kosztuje, a chroni przed najprostszego typu błędami okablowania. Wyłączanie STP „bo przeszkadza” zwykle kończy się tym, że za pierwszym razem, gdy ktoś wpiśnie dodatkowy switch z marketu, infrastruktura siada.

Co to jest BPDU Guard i kiedy warto go używać?

BPDU Guard to prosta ochrona portów dostępowych. Jeśli na takim porcie pojawią się ramki STP (BPDU), port przechodzi w err-disable, czyli zostaje wyłączony przez switch. W praktyce oznacza to, że ktoś próbował podpiąć inny przełącznik lub urządzenie, które może wprowadzić pętlę lub zakłócić działanie STP.

Najlepszy efekt przy minimalnym wysiłku daje włączenie BPDU Guard masowo na portach typu access (do komputerów, telefonów, AP), a zostawienie go wyłączonego tylko na uplinkach między switchami. To szybka konfiguracja „raz na sieć”, która potrafi uratować dzień, gdy ktoś pod biurkiem zepnie dwa gniazda krótkim kablem.

Jak ustawić root bridge, żeby sieć zachowywała się przewidywalnie?

Root bridge powinien być w części dystrybucyjnej lub core, czyli na najsolidniejszych, centralnych przełącznikach. Na tych switchach ustaw niski priorytet STP (np. 4096 lub 8192), a na switchach dostępowych zostaw domyślne 32768 albo nawet podnieś priorytet, aby nie zostały przypadkowo rootem.

Bez takiego planu rootem zostaje po prostu switch z najniższym adresem MAC. Może to być mały, tani przełącznik w szafce w magazynie, przez co ruch będzie szedł kompletnie nielogicznymi ścieżkami. Jednorazowe zaplanowanie root bridge to kilka minut pracy, które potem oszczędzają sporo czasu przy każdej awarii w warstwie 2.

Jak odróżnić pętlę w sieci od „zwykłego” dużego ruchu lub ataku DDoS?

Przy pętli problemy widać także w komunikacji wewnątrz tej samej podsieci – między dwoma hostami za tym samym przełącznikiem. Równocześnie łącze do internetu może być relatywnie spokojne, za to uplinki między switchami są prawie zapchane. W statystykach ruchu dominuje broadcast i multicast, a nie strumień z jednego konkretnego hosta.

Przy dużym „normalnym” ruchu zwykle łatwo wskazać główne źródło (backup, kopia maszyn wirtualnych, duży upload do chmury). Przy pętli obraz jest bardziej chaotyczny, a logi STP zgłaszają częste zmiany topologii. Jeśli do tego dochodzi niemal ciągłe miganie większości portów na switchu – to silna wskazówka, że problem leży w warstwie 2, a nie tylko w „zapchanym łączu”.

Co warto zapamiętać

- Największy zysk daje szybkie rozpoznanie, czy problemem jest pętla w warstwie 2: typowe sygnały to losowe gubienie pingów w tej samej podsieci, brak adresów z DHCP, zrywanie sesji RDP/VPN i VoIP przy jednoczesnym „zapchaniu” wielu portów na switchach.

- Pętla potrafi sparaliżować całą firmę z powodu lawiny broadcastów i ciągłego przepisywania tablic MAC, mimo że łącze do internetu może być w porządku – przeciążenie widać głównie na uplinkach i CPU przełączników.

- Nie trzeba drogich przełączników ani rozbudowanego monitoringu: kluczowe są podstawy STP (root bridge, jedna logiczna ścieżka), proste checklisty i porządek w okablowaniu, żeby przypadkowy patchcord w sali konferencyjnej nie zabił całej sieci.

- Mechanizmy ochronne typu BPDU Guard, Loop Guard czy Root Guard są „tanim ubezpieczeniem” – prawidłowo ustawione automatycznie odcinają problematyczne porty i znacząco skracają czas awarii, zanim administrator zdąży dotrzeć na miejsce.

- Obraz z punktu widzenia sprzętu jest bardzo charakterystyczny: wysoki CPU na switchach, liczniki ruchu blisko 100% na wielu interfejsach, częste zmiany topologii STP w logach, a czasem nawet utrata dostępu do zarządzania urządzeniem.

- Łatwo pomylić pętlę z „dużym ruchem” albo atakiem DDoS, ale różnicą jest to, że problemy pojawiają się także między hostami w tej samej sieci lokalnej, a ruch ma charakter masowych broadcastów i multicastów z wielu źródeł, a nie jednego „głośnego” hosta.